|

--- |

|

base_model: cenkersisman/gpt2-turkish-128-token |

|

inference: false |

|

language: |

|

- tr |

|

model_creator: cenkersisman |

|

model_name: gpt2-turkish-128-token |

|

pipeline_tag: text-generation |

|

quantized_by: afrideva |

|

tags: |

|

- gguf |

|

- ggml |

|

- quantized |

|

- q2_k |

|

- q3_k_m |

|

- q4_k_m |

|

- q5_k_m |

|

- q6_k |

|

- q8_0 |

|

widget: |

|

- example_title: fransa'nın başkenti |

|

text: fransa'nın başkenti |

|

- example_title: ingiltere'nin başkenti |

|

text: ingiltere'nın başkenti |

|

- example_title: italya'nın başkenti |

|

text: italya'nın başkenti |

|

- example_title: moğolistan'ın başkenti |

|

text: moğolistan'ın başkenti |

|

- example_title: amazon ormanlarının bulunduğu ülke olan |

|

text: amazon ormanlarının bulunduğu ülke olan |

|

- example_title: avrupa'yı asya'ya bağlayan şehir |

|

text: avrupa'yı asya'ya bağlayan şehir |

|

- example_title: zebraların yaşadığı kıta olan |

|

text: zebraların yaşadığı kıta olan |

|

- example_title: fenerbahçe'nin ezeli rakibi olan |

|

text: fenerbahçe'nin ezeli rakibi olan |

|

- example_title: tek bacaklı kurbağa |

|

text: tek bacaklı kurbağa |

|

- example_title: rize'de yağmur |

|

text: rize'de yağmur |

|

- example_title: hayatın anlamı |

|

text: hayatın anlamı |

|

- example_title: saint-joseph |

|

text: saint-joseph |

|

- example_title: renk isimleri şunlardır |

|

text: renk isimleri şunlardır |

|

- example_title: iklim değişikliği |

|

text: iklim değişikliği |

|

- example_title: tuzlu yiyecekler arasında |

|

text: tuzlu yiyecekler arasında |

|

--- |

|

# cenkersisman/gpt2-turkish-128-token-GGUF |

|

|

|

Quantized GGUF model files for [gpt2-turkish-128-token](https://huggingface.co/cenkersisman/gpt2-turkish-128-token) from [cenkersisman](https://huggingface.co/cenkersisman) |

|

|

|

|

|

| Name | Quant method | Size | |

|

| ---- | ---- | ---- | |

|

| [gpt2-turkish-128-token.fp16.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.fp16.gguf) | fp16 | 328.01 MB | |

|

| [gpt2-turkish-128-token.q2_k.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.q2_k.gguf) | q2_k | 81.10 MB | |

|

| [gpt2-turkish-128-token.q3_k_m.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.q3_k_m.gguf) | q3_k_m | 95.37 MB | |

|

| [gpt2-turkish-128-token.q4_k_m.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.q4_k_m.gguf) | q4_k_m | 110.07 MB | |

|

| [gpt2-turkish-128-token.q5_k_m.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.q5_k_m.gguf) | q5_k_m | 124.01 MB | |

|

| [gpt2-turkish-128-token.q6_k.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.q6_k.gguf) | q6_k | 135.82 MB | |

|

| [gpt2-turkish-128-token.q8_0.gguf](https://huggingface.co/afrideva/gpt2-turkish-128-token-GGUF/resolve/main/gpt2-turkish-128-token.q8_0.gguf) | q8_0 | 175.27 MB | |

|

|

|

|

|

|

|

## Original Model Card: |

|

# Model |

|

|

|

GPT-2 Türkçe Modeli |

|

|

|

### Model Açıklaması |

|

|

|

GPT-2 Türkçe Modeli, Türkçe diline özelleştirilmiş olan GPT-2 mimarisi temel alınarak oluşturulmuş bir dil modelidir. Belirli bir başlangıç metni temel alarak insana benzer metinler üretme yeteneğine sahiptir ve geniş bir Türkçe metin veri kümesi üzerinde eğitilmiştir. |

|

Modelin eğitimi için 900 milyon karakterli Vikipedi seti kullanılmıştır. Eğitim setindeki cümleler maksimum 128 tokendan (token = kelime kökü ve ekleri) oluşmuştur bu yüzden oluşturacağı cümlelerin boyu sınırlıdır.. |

|

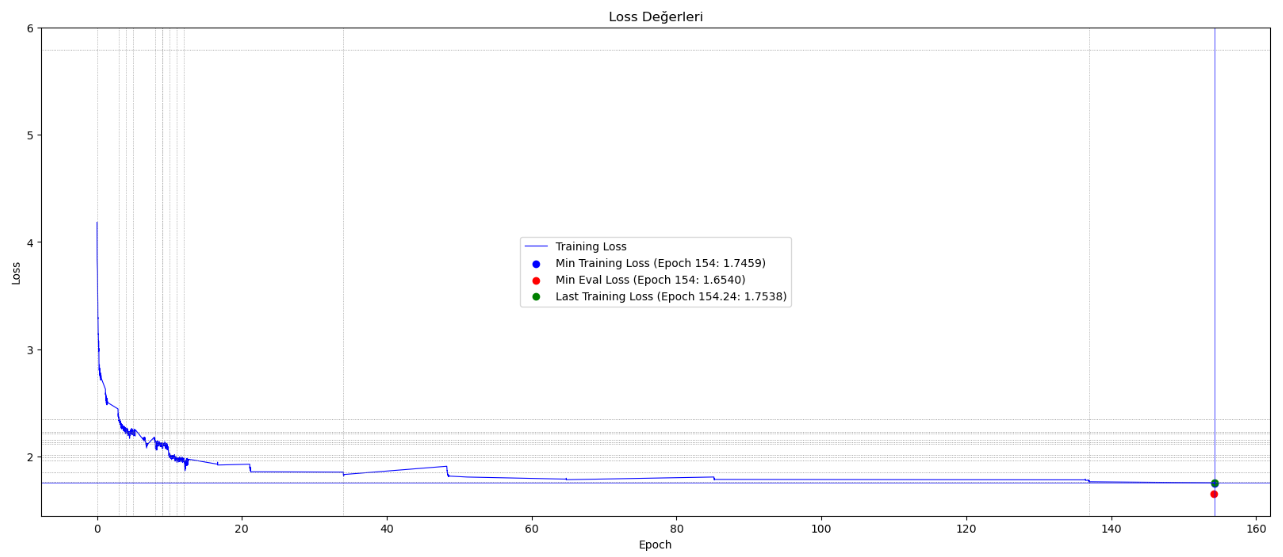

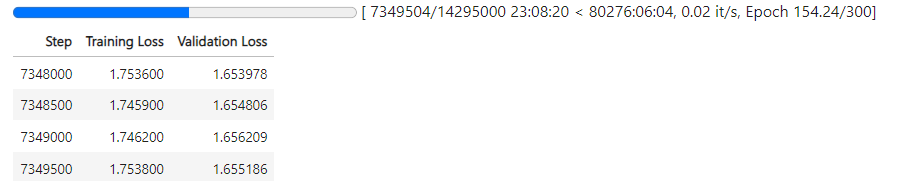

Türkçe heceleme yapısına uygun tokenizer kullanılmış ve model 7.5 milyon adımda yaklaşık 154 epoch eğitilmiştir. |

|

Eğitim için 4GB hafızası olan Nvidia Geforce RTX 3050 GPU kullanılmaktadır. 16GB Paylaşılan GPU'dan da yararlanılmakta ve eğitimin devamında toplamda 20GB hafıza kullanılmaktadır. |

|

|

|

## Model Nasıl Kullanılabilir |

|

ÖNEMLİ: model harf büyüklüğüne duyarlı olduğu için, prompt tamamen küçük harflerle yazılmalıdır. |

|

|

|

```python |

|

# Model ile çıkarım yapmak için örnek kod |

|

|

|

from transformers import GPT2Tokenizer, GPT2LMHeadModel |

|

|

|

model_name = "cenkersisman/gpt2-turkish-128-token" |

|

tokenizer = GPT2Tokenizer.from_pretrained(model_name) |

|

model = GPT2LMHeadModel.from_pretrained(model_name) |

|

|

|

prompt = "okyanusun derinliklerinde bulunan" |

|

input_ids = tokenizer.encode(prompt, return_tensors="pt") |

|

output = model.generate(input_ids, max_length=100, pad_token_id=tokenizer.eos_token_id) |

|

generated_text = tokenizer.decode(output[0], skip_special_tokens=True) |

|

print(generated_text) |

|

|

|

``` |

|

## Eğitim Süreci Eğrisi |

|

|

|

|

|

|

|

|

|

## Sınırlamalar ve Önyargılar |

|

Bu model, bir özyineli dil modeli olarak eğitildi. Bu, temel işlevinin bir metin dizisi alıp bir sonraki belirteci tahmin etmek olduğu anlamına gelir. Dil modelleri bunun dışında birçok görev için yaygın olarak kullanılsa da, bu çalışmayla ilgili birçok bilinmeyen bulunmaktadır. |

|

|

|

Model, küfür, açık saçıklık ve aksi davranışlara yol açan metinleri içerdiği bilinen bir veri kümesi üzerinde eğitildi. Kullanım durumunuza bağlı olarak, bu model toplumsal olarak kabul edilemez metinler üretebilir. |

|

|

|

Tüm dil modellerinde olduğu gibi, bu modelin belirli bir girişe nasıl yanıt vereceğini önceden tahmin etmek zordur ve uyarı olmaksızın saldırgan içerik ortaya çıkabilir. Sonuçları yayınlamadan önce hem istenmeyen içeriği sansürlemek hem de sonuçların kalitesini iyileştirmek için insanların çıktıları denetlemesini veya filtrelemesi önerilir. |