Commit

•

6c6576e

1

Parent(s):

eb733cd

Update README.md

Browse files

README.md

CHANGED

|

@@ -1,13 +1,15 @@

|

|

| 1 |

---

|

| 2 |

widget:

|

| 3 |

-

- text: '

|

| 4 |

-

example_title:

|

| 5 |

-

- text: '

|

| 6 |

-

example_title:

|

| 7 |

-

- text: '

|

| 8 |

-

example_title:

|

| 9 |

-

- text: '

|

| 10 |

-

example_title:

|

|

|

|

|

|

|

| 11 |

- text: 'hayatın anlamı'

|

| 12 |

example_title: hayatın anlamı

|

| 13 |

- text: 'saint-joseph'

|

|

@@ -22,22 +24,23 @@ language:

|

|

| 22 |

# Model

|

| 23 |

|

| 24 |

GPT-2 Türkçe Modeli

|

| 25 |

-

|

| 26 |

### Model Açıklaması

|

| 27 |

|

| 28 |

GPT-2 Türkçe Modeli, Türkçe diline özelleştirilmiş olan GPT-2 mimarisi temel alınarak oluşturulmuş bir dil modelidir. Belirli bir başlangıç metni temel alarak insana benzer metinler üretme yeteneğine sahiptir ve geniş bir Türkçe metin veri kümesi üzerinde eğitilmiştir.

|

| 29 |

-

Modelin eğitimi için 900 milyon karakterli Vikipedi seti kullanılmıştır. Eğitim setindeki cümleler maksimum

|

| 30 |

-

Türkçe heceleme yapısına uygun tokenizer kullanılmış ve model 7.5 milyon adımda yaklaşık

|

| 31 |

-

Eğitim için 4GB hafızası olan Nvidia Geforce RTX 3050 GPU kullanılmaktadır.

|

| 32 |

|

| 33 |

## Model Nasıl Kullanılabilir

|

|

|

|

| 34 |

|

| 35 |

```python

|

| 36 |

# Model ile çıkarım yapmak için örnek kod

|

| 37 |

|

| 38 |

from transformers import GPT2Tokenizer, GPT2LMHeadModel

|

| 39 |

|

| 40 |

-

model_name = "cenkersisman/gpt2-turkish-

|

| 41 |

tokenizer = GPT2Tokenizer.from_pretrained(model_name)

|

| 42 |

model = GPT2LMHeadModel.from_pretrained(model_name)

|

| 43 |

|

|

@@ -50,9 +53,9 @@ print(generated_text)

|

|

| 50 |

```

|

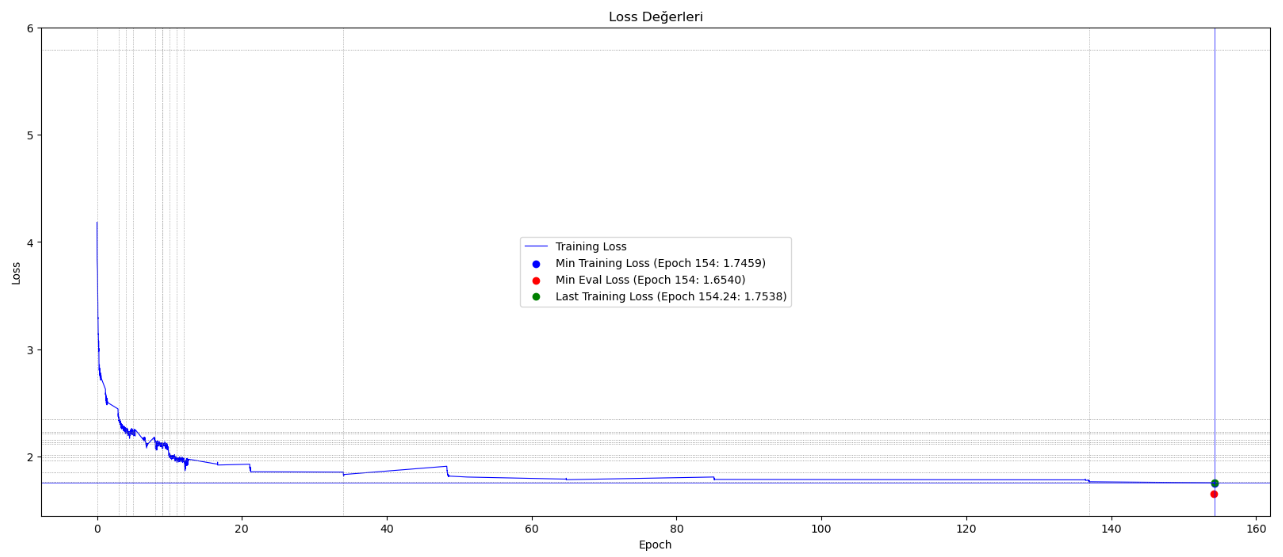

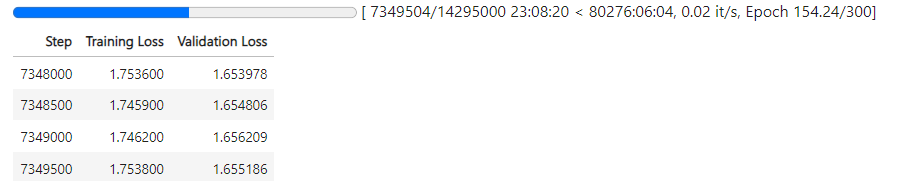

| 51 |

## Eğitim Süreci Eğrisi

|

| 52 |

|

| 53 |

-

oluşmuştur bu yüzden oluşturacağı cümlelerin boyu sınırlıdır..

|

| 32 |

+

Türkçe heceleme yapısına uygun tokenizer kullanılmış ve model 7.5 milyon adımda yaklaşık 154 epoch eğitilmiştir.

|

| 33 |

+

Eğitim için 4GB hafızası olan Nvidia Geforce RTX 3050 GPU kullanılmaktadır. 16GB Paylaşılan GPU'dan da yararlanılmakta ve eğitimin devamında toplamda 20GB hafıza kullanılmaktadır.

|

| 34 |

|

| 35 |

## Model Nasıl Kullanılabilir

|

| 36 |

+

ÖNEMLİ: model harf büyüklüğüne duyarlı olduğu için, prompt tamamen küçük harflerle yazılmalıdır.

|

| 37 |

|

| 38 |

```python

|

| 39 |

# Model ile çıkarım yapmak için örnek kod

|

| 40 |

|

| 41 |

from transformers import GPT2Tokenizer, GPT2LMHeadModel

|

| 42 |

|

| 43 |

+

model_name = "cenkersisman/gpt2-turkish-128-token"

|

| 44 |

tokenizer = GPT2Tokenizer.from_pretrained(model_name)

|

| 45 |

model = GPT2LMHeadModel.from_pretrained(model_name)

|

| 46 |

|

|

|

|

| 53 |

```

|

| 54 |

## Eğitim Süreci Eğrisi

|

| 55 |

|

| 56 |

+

|

| 57 |

|

| 58 |

+

|

| 59 |

## Sınırlamalar ve Önyargılar

|

| 60 |

Bu model, bir özyineli dil modeli olarak eğitildi. Bu, temel işlevinin bir metin dizisi alıp bir sonraki belirteci tahmin etmek olduğu anlamına gelir. Dil modelleri bunun dışında birçok görev için yaygın olarak kullanılsa da, bu çalışmayla ilgili birçok bilinmeyen bulunmaktadır.

|

| 61 |

|