pom

commited on

Commit

•

bb1ea61

1

Parent(s):

ad4d20f

update readme

Browse files- README.md +208 -162

- superclue.png +0 -0

README.md

CHANGED

|

@@ -16,204 +16,254 @@ inference: false

|

|

| 16 |

|:-------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|

|

| 17 |

| Ratio(%) | 21.2 | 18.6 | 12.4 | 11.3 | 9.8 | 6.8 | 5.4 | 5.1 | 4.8 | 4.6 |

|

| 18 |

|

| 19 |

-

|

| 20 |

|

| 21 |

-

|

| 22 |

-

- **训练数据**:构建了 2.6 万亿 token 的高质量、多样化的数据对模型进行充分训练,包含中、英、俄、西等 40 多种语言,通过精细化设置不同类型数据的采样比例,使得中英两种语言表现优异,也能兼顾其他语言效果。

|

| 23 |

-

- **分词**:基于 BPE(Byte-Pair Encoding)算法,使用上百 GB 语料训练了一个词表大小为 100,534 的分词器,能够同时支持多语言,而无需额外扩展词表。

|

| 24 |

-

- **训练框架**:训练中采用 FlashAttention2 加速计算,3D 并行基础上采用虚拟流水线(virtual pipeline)技术,降低较长流水线和 16k 上下文窗口产生的过高气泡率,在千卡集群的峰值算力利用率达到业界前列。同时通过集群基础设施运营、资源调度、训练框架和调度平台协同等持续优化,打造出高稳定、低中断、强容错的训练系统,将每周有效训练率提升至 98.6%。

|

| 25 |

|

| 26 |

-

|

| 27 |

|

| 28 |

-

|

| 29 |

-

|:------:|:-------:|:-------:|:--------:|:-----:|:-------------:|

|

| 30 |

-

| 65B | 8192 | 64 | 80 | 22016 | 1.5e−4 |

|

| 31 |

|

| 32 |

-

|

| 33 |

|

| 34 |

-

|

|

|

|

|

|

|

|

|

|

| 35 |

|

| 36 |

-

|

| 37 |

-

|

| 38 |

-

| 网页类 | Y | Y | Y | Y | Y | Y | Y | Y |

|

| 39 |

-

| 代码类 | | Y | Y | Y | Y | Y | Y | Y |

|

| 40 |

-

| 百科类 | Y | Y | | Y | Y | Y | Y | Y |

|

| 41 |

-

| 书籍类 | Y | Y | | Y | Y | Y | Y | Y |

|

| 42 |

-

| 论文类 | | Y | | | | | Y | Y |

|

| 43 |

-

| 问答类 | Y | Y | | Y | | | Y | Y |

|

| 44 |

|

| 45 |

-

|

|

|

|

| 46 |

|

| 47 |

-

|

| 48 |

-

|

| 49 |

-

|:-------:|:------:|:------:|:------:|:------:|:------:|:------:|:------:|

|

| 50 |

-

| 比例(%) | 72.91 | 7.09 | 4.81 | 5.62 | 6.55 | 1.15 | 1.87 |

|

| 51 |

|

| 52 |

-

|

|

|

|

| 53 |

|

| 54 |

-

|

| 55 |

-

|

| 56 |

-

| en | 54.91 | pl | 0.48 | hu | 0.19 | ar | 0.12 | fa | 0.07 | sl | 0.05 |

|

| 57 |

-

| zh | 31.09 | it | 0.36 | ko | 0.18 | ro | 0.11 | hi | 0.07 | et | 0.04 |

|

| 58 |

-

| ja | 3.22 | pt | 0.34 | sv | 0.15 | bg | 0.10 | no | 0.07 | lv | 0.03 |

|

| 59 |

-

| ru | 3.15 | cs | 0.27 | el | 0.14 | th | 0.10 | ca | 0.06 | sr | 0.03 |

|

| 60 |

-

| de | 1.52 | uk | 0.24 | fi | 0.14 | da | 0.09 | iw | 0.06 | ta | 0.03 |

|

| 61 |

-

| es | 0.91 | tr | 0.23 | id | 0.13 | mr | 0.08 | lt | 0.05 | kk | 0.02 |

|

| 62 |

-

| fr | 0.73 | nl | 0.20 | vi | 0.13 | sk | 0.08 | ms | 0.05 | | |

|

| 63 |

|

| 64 |

-

|

|

|

|

| 65 |

|

| 66 |

-

|

|

|

|

|

|

|

|

|

|

| 67 |

|

| 68 |

-

|

| 69 |

-

|:----------:|:-------:|:------:|:-------:|:------------:|:-------:|:----------:|:-------:|:-------------:|:-------:|:-------:|:-------:|

|

| 70 |

-

| PHP | 17.06 | Go | 3.38 | Shell | 0.74 | PowerShell | 0.23 | Arduino | 0.13 | R | 0.04 |

|

| 71 |

-

| JavaScript | 15.65 | Rust | 2.33 | Haskell | 0.46 | Groovy | 0.21 | Assembly | 0.13 | ABAP | 0.01 |

|

| 72 |

-

| Java | 15.18 | Ruby | 1.61 | Common Lisp | 0.43 | Pascal | 0.20 | Clojure | 0.12 | COBOL | 0.0022 |

|

| 73 |

-

| Python | 14.64 | Swift | 1.40 | Perl | 0.34 | FORTRAN | 0.19 | Cuda | 0.12 | Verilog | 0.0001 |

|

| 74 |

-

| TypeScript | 6.55 | Kotlin | 1.40 | CSS | 0.32 | Elixir | 0.17 | VHDL | 0.09 | | |

|

| 75 |

-

| C | 4.84 | Scala | 1.08 | Julia | 0.32 | Solidity | 0.16 | Emacs Lisp | 0.08 | | |

|

| 76 |

-

| C++ | 4.68 | Dart | 0.95 | Visual Basic | 0.25 | F# | 0.14 | Objective-C++ | 0.08 | | |

|

| 77 |

-

| C# | 3.44 | SQL | 0.76 | OCaml | 0.24 | Erlang | 0.14 | Crystal | 0.06 | | |

|

| 78 |

|

| 79 |

-

|

|

|

|

|

|

|

| 80 |

|

| 81 |

-

|

|

|

|

| 82 |

|

| 83 |

-

|

| 84 |

-

|

| 85 |

-

|

| 86 |

-

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 87 |

|

| 88 |

-

|

| 89 |

|

| 90 |

-

|

| 91 |

-

|

| 92 |

-

|

| 93 |

-

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 94 |

|

| 95 |

-

|

| 96 |

|

| 97 |

-

|

| 98 |

-

|

| 99 |

-

|

| 100 |

|

| 101 |

-

|

|

|

|

| 102 |

|

| 103 |

-

|

| 104 |

|

| 105 |

-

|

| 106 |

-

|:---------------:|:--------:|:---------:|:---------:|:--------:|:--------------:|:----------:|:----------:|:----------:|

|

| 107 |

-

| Web Pages | Y | Y | Y | Y | Y | Y | Y | Y |

|

| 108 |

-

| Code | | Y | Y | Y | Y | Y | Y | Y |

|

| 109 |

-

| Encyclopedia | Y | Y | | Y | Y | Y | Y | Y |

|

| 110 |

-

| Books | Y | Y | | Y | Y | Y | Y | Y |

|

| 111 |

-

| Academic Papers | | Y | | | | | Y | Y |

|

| 112 |

-

| QA | Y | Y | | Y | | | Y | Y |

|

| 113 |

|

| 114 |

-

|

| 115 |

|

| 116 |

-

|

| 117 |

-

| | Web Pages | Code | Encyclopedia | Books | Academic Papers | QA | Other |

|

| 118 |

-

|:--------------:|:---------:|:----:|:------------:|:-----:|:---------------:|:----:|:-----:|

|

| 119 |

-

| Proportion (%) | 72.91 | 7.09 | 4.81 | 5.62 | 6.55 | 1.15 | 1.87 |

|

| 120 |

|

| 121 |

-

|

|

|

|

| 122 |

|

| 123 |

-

|

| 124 |

-

|:--------:|:--------------:|:--------:|:--------------:|:--------:|:--------------:|:--------:|:--------------:|:--------:|:--------------:|:--------:|:--------------:|

|

| 125 |

-

| en | 54.91 | pl | 0.48 | hu | 0.19 | ar | 0.12 | fa | 0.07 | sl | 0.05 |

|

| 126 |

-

| zh | 31.09 | it | 0.36 | ko | 0.18 | ro | 0.11 | hi | 0.07 | et | 0.04 |

|

| 127 |

-

| ja | 3.22 | pt | 0.34 | sv | 0.15 | bg | 0.10 | no | 0.07 | lv | 0.03 |

|

| 128 |

-

| ru | 3.15 | cs | 0.27 | el | 0.14 | th | 0.10 | ca | 0.06 | sr | 0.03 |

|

| 129 |

-

| de | 1.52 | uk | 0.24 | fi | 0.14 | da | 0.09 | iw | 0.06 | ta | 0.03 |

|

| 130 |

-

| es | 0.91 | tr | 0.23 | id | 0.13 | mr | 0.08 | lt | 0.05 | kk | 0.02 |

|

| 131 |

-

| fr | 0.73 | nl | 0.20 | vi | 0.13 | sk | 0.08 | ms | 0.05 | | |

|

| 132 |

|

| 133 |

-

|

|

|

|

|

|

|

| 134 |

|

| 135 |

-

|

|

|

|

|

|

|

|

|

|

| 136 |

|

| 137 |

-

|

| 138 |

-

|:--------------------:|:--------------:|:--------------------:|:--------------:|:--------------------:|:--------------:|:--------------------:|:--------------:|:--------------------:|:--------------:|:--------------------:|:--------------:|

|

| 139 |

-

| PHP | 17.06 | Go | 3.38 | Shell | 0.74 | PowerShell | 0.23 | Arduino | 0.13 | R | 0.04 |

|

| 140 |

-

| JavaScript | 15.65 | Rust | 2.33 | Haskell | 0.46 | Groovy | 0.21 | Assembly | 0.13 | ABAP | 0.01 |

|

| 141 |

-

| Java | 15.18 | Ruby | 1.61 | Common Lisp | 0.43 | Pascal | 0.20 | Clojure | 0.12 | COBOL | 0.0022 |

|

| 142 |

-

| Python | 14.64 | Swift | 1.40 | Perl | 0.34 | FORTRAN | 0.19 | Cuda | 0.12 | Verilog | 0.0001 |

|

| 143 |

-

| TypeScript | 6.55 | Kotlin | 1.40 | CSS | 0.32 | Elixir | 0.17 | VHDL | 0.09 | | |

|

| 144 |

-

| C | 4.84 | Scala | 1.08 | Julia | 0.32 | Solidity | 0.16 | Emacs Lisp | 0.08 | | |

|

| 145 |

-

| C++ | 4.68 | Dart | 0.95 | Visual Basic | 0.25 | F# | 0.14 | Objective-C++ | 0.08 | | |

|

| 146 |

-

| C# | 3.44 | SQL | 0.76 | OCaml | 0.24 | Erlang | 0.14 | Crystal | 0.06 | | |

|

| 147 |

|

| 148 |

-

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 149 |

|

| 150 |

-

|

| 151 |

-

|

| 152 |

-

|

| 153 |

-

|

| 154 |

-

|

| 155 |

-

|

| 156 |

-

|

| 157 |

-

|

| 158 |

-

|

| 159 |

-

|

| 160 |

-

|

| 161 |

-

|

| 162 |

-

|

| 163 |

-

|

| 164 |

-

|

| 165 |

-

|

| 166 |

-

|

| 167 |

-

|

| 168 |

-

|

| 169 |

-

|

| 170 |

-

|

| 171 |

-

|

| 172 |

-

|

| 173 |

-

|

| 174 |

-

|

| 175 |

-

|

| 176 |

-

|

| 177 |

-

|

| 178 |

-

|

| 179 |

-

|

| 180 |

-

|

| 181 |

-

|

| 182 |

-

|

| 183 |

-

|

| 184 |

-

|

| 185 |

-

|

| 186 |

-

|

| 187 |

-

|

| 188 |

-

|

| 189 |

-

|

| 190 |

-

|

| 191 |

-

|

| 192 |

-

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 193 |

|

| 194 |

## 使用方法

|

| 195 |

|

| 196 |

### 硬件需求

|

| 197 |

-

下表列出了在 XVERSE-65B 上进行推理和微调所需要的硬件资源:

|

| 198 |

| | 类型 | 方法 | 内存 | GPU |

|

| 199 |

| ---------- | ---- | ---------------- | ------ | ---------- |

|

| 200 |

-

| XVERSE-65B | 训练 | LoRA with ZeRO-3 | 1500GB | 8*A800 80G |

|

| 201 |

-

| XVERSE-65B | 推理 | BF16/FP16 | 500GB | 2*A800 80G |

|

| 202 |

|

| 203 |

## Usage

|

| 204 |

|

| 205 |

### Hardware requirements

|

| 206 |

-

The following table lists the hardware resources required for inference and fine-tuning on XVERSE-65B:

|

| 207 |

| | Type | Kind | Memory | GPU |

|

| 208 |

| ---------- | --------- | ---------------- | ------ | ---------- |

|

| 209 |

-

| XVERSE-65B | Training | LoRA with ZeRO-3 | 1500GB | 8*A800 80G |

|

| 210 |

-

| XVERSE-65B | Inference | BF16/FP16 | 500GB | 2*A800 80G |

|

| 211 |

|

| 212 |

### Loading with Transformers

|

| 213 |

|

| 214 |

-

可通过以下代码加载 XVERSE-65B 模型进行推理:

|

| 215 |

|

| 216 |

-

The XVERSE-65B model can be loaded for inference using the following code:

|

| 217 |

|

| 218 |

```python

|

| 219 |

import torch

|

|

@@ -233,30 +283,26 @@ response = model.chat(tokenizer, history)

|

|

| 233 |

print(response)

|

| 234 |

```

|

| 235 |

|

| 236 |

-

更多有关相关细节,包括文本生成demo和环境依赖,请参考我们的[Github](https://github.com/xverse-ai/XVERSE-65B)。

|

| 237 |

-

|

| 238 |

-

For more details, including the demo of text generation and environmental dependencies, please refer to our [Github](https://github.com/xverse-ai/XVERSE-65B).

|

| 239 |

-

|

| 240 |

## 局限性与免责申明

|

| 241 |

|

| 242 |

-

XVERSE-65B 与其他所有 LLM 一样,在某些情况下可能会产生不准确、有偏见或其他令人反感的内容。因此,请谨慎使用模型生成的内容,请勿将生成的有害内容进行传播,在部署任何 XVERSE-65B 的应用之前,开发人员应根据其具体应用对模型进行安全测试和调优。

|

| 243 |

|

| 244 |

-

我们强烈警告不要将 XVERSE-65B 模型用于制造或传播有害信息,或进行任何可能损害公众、国家、社会安全或违反法规的活动。如果使用 XVERSE-65B 模型产生任何问题,无论是数据安全问题、公共舆论风险,还是模型被误解、滥用、传播或不合规使用所引发的任何风险和问题,我们将不承担任何责任。

|

| 245 |

|

| 246 |

## Limitations and Disclaimer

|

| 247 |

|

| 248 |

-

Like all other Large Language Models (LLMs), XVERSE-65B may produce inaccurate, biased, or otherwise offensive content under certain circumstances. Therefore, please use the content generated by the model with caution and refrain from disseminating harmful content. Before deploying any application of XVERSE-65B, developers should conduct safety tests and optimization of the model according to its specific application.

|

| 249 |

|

| 250 |

-

We strongly warn against the use of the XVERSE-65B model for producing or spreading harmful information, or conducting any activities that might harm the public, national, or social security, or violate regulations. We assume no responsibility for any problems arising from the use of the XVERSE-65B model, whether it be data security issues, public opinion risks, or any risks and issues caused by misunderstanding, misuse, dissemination, or non-compliance with the model.

|

| 251 |

|

| 252 |

## 模型开源协议

|

| 253 |

|

| 254 |

-

使用本仓库的源码需要遵循 [Apache-2.0](https://github.com/xverse-ai/XVERSE-65B/blob/main/LICENSE) 开源协议,使用 XVERSE-65B 的模型权重则需要遵循[模型许可协议](https://github.com/xverse-ai/XVERSE-65B/blob/main/MODEL_LICENSE.pdf)。

|

| 255 |

|

| 256 |

-

XVERSE-65B 模型权重对学术研究**完全开放**,并且支持**免费商用**。如需申请商业许可证,请填写【[申请表](https://chat.xverse.cn/home/business.html)】,如有其他问题或合作,请联系 <opensource@xverse.cn>。

|

| 257 |

|

| 258 |

## Open Source License

|

| 259 |

|

| 260 |

-

The use of the source code in this repository must follow the [Apache-2.0](https://github.com/xverse-ai/XVERSE-65B/blob/main/LICENSE) open-source license, while the use of the model weights of XVERSE-65B needs to adhere to the [Model License Agreement](https://github.com/xverse-ai/XVERSE-65B/blob/main/MODEL_LICENSE.pdf).

|

| 261 |

|

| 262 |

-

The XVERSE-65B model weights are **fully open** to academic research and support **free commercial use**. To apply for a commercial license, please fill in the [application form](https://chat.xverse.cn/home/business.html). For other questions or collaborations, please contact <opensource@xverse.cn>.

|

|

|

|

| 16 |

|:-------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|:--------:|

|

| 17 |

| Ratio(%) | 21.2 | 18.6 | 12.4 | 11.3 | 9.8 | 6.8 | 5.4 | 5.1 | 4.8 | 4.6 |

|

| 18 |

|

| 19 |

+

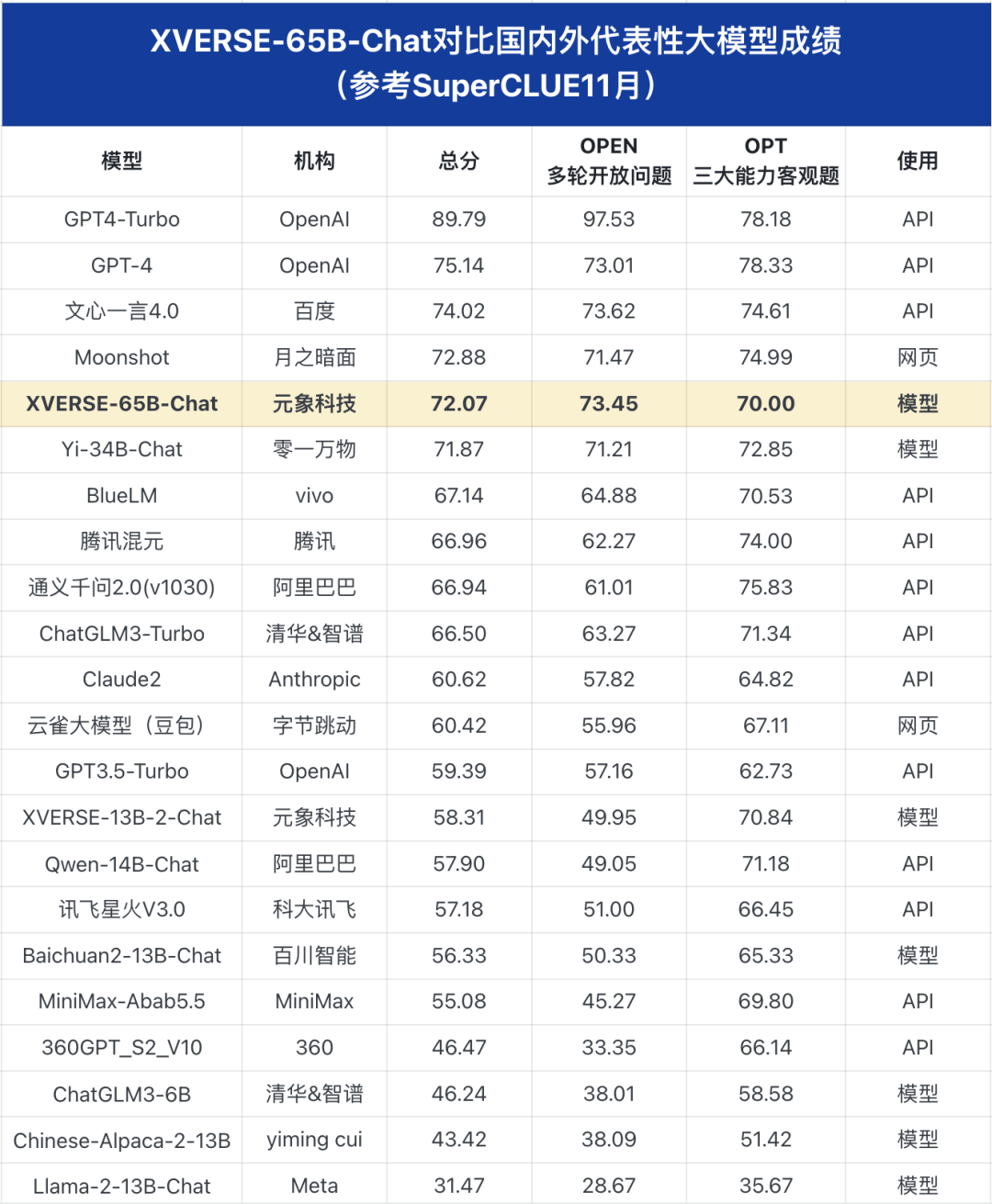

## 评测结果

|

| 20 |

|

| 21 |

+

SuperCLUE 11月大模型综合评测榜单排名第五,中文开源大模型第一

|

|

|

|

|

|

|

|

|

|

| 22 |

|

| 23 |

+

<img src="./superclue.png">

|

| 24 |

|

| 25 |

+

## 输出示例

|

|

|

|

|

|

|

| 26 |

|

| 27 |

+

<details><summary><b>角色扮演</b></summary>

|

| 28 |

|

| 29 |

+

```

|

| 30 |

+

用户:

|

| 31 |

+

扮演杨过与我对话

|

| 32 |

+

你是谁

|

| 33 |

|

| 34 |

+

XVERSE-65B-Chat:

|

| 35 |

+

在下杨过,字改之,号西狂。昔日少年落魄,历经坎坷,幸得神雕相伴,习得绝世武功,终成一代宗师。如今遇见阁下,不知有何指教?

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 36 |

|

| 37 |

+

用户:

|

| 38 |

+

阁下的妻子是谁

|

| 39 |

|

| 40 |

+

XVERSE-65B-Chat:

|

| 41 |

+

小龙女,她是我的爱侣,也是我生命中最重要的人。我们在绝情谷底分离十六年后重逢,那份深情一直未曾改变。她冰清玉洁、超凡脱俗,是我心中的挚爱。

|

|

|

|

|

|

|

| 42 |

|

| 43 |

+

用户:

|

| 44 |

+

退出扮演

|

| 45 |

|

| 46 |

+

XVERSE-65B-Chat:

|

| 47 |

+

好的,我现在停止扮演杨过的角色。如果您还有其他问题或需要帮助,请随时告诉我。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 48 |

|

| 49 |

+

用户:

|

| 50 |

+

你是谁

|

| 51 |

|

| 52 |

+

XVERSE-65B-Chat:

|

| 53 |

+

我是一个人工智能语言模型,名为XChat,由元象公司开发。我基于Transformer架构进行训练,能够理解和生成自然语言。我可以回答问题、提供信息、参与对话以及创作文本等任务。需要注意的是,我没有自我意识或个人情感,只是一个能理解和生成文本的工具。我的知识截止到2023年7月,所以关于更近期事件和发展的信息可能不包括在内。如果有任何问题,我会尽力提供帮助!

|

| 54 |

+

```

|

| 55 |

+

</details>

|

| 56 |

|

| 57 |

+

<details><summary><b>知识问答</b></summary>

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 58 |

|

| 59 |

+

```

|

| 60 |

+

用户:

|

| 61 |

+

黑暗骑士导演是谁

|

| 62 |

|

| 63 |

+

XVERSE-65B-Chat:

|

| 64 |

+

《黑暗骑士》(The Dark Knight)的导演是克里斯托弗·诺兰(Christopher Nolan)。这部电影是蝙蝠侠系列电影的一部分,并且被认为是超级英雄电影中最杰出和最受欢迎的作品之一。

|

| 65 |

|

| 66 |

+

用户:

|

| 67 |

+

里面小丑谁扮演的

|

| 68 |

+

|

| 69 |

+

XVERSE-65B-Chat:

|

| 70 |

+

在电影《黑暗骑士》中,小丑这一角色由著名演员希斯·莱杰(Heath Ledger)扮演。他的表演赢得了全球观众的赞誉,并为他赢得了奥斯卡最佳男配角奖,遗憾的是,这是他生前获得的最后一个荣誉,因为他在2008年不幸去世。希斯·莱杰对小丑这个角色的诠释至今仍被广泛认为是影史上最伟大的反派表演之一。

|

| 71 |

+

|

| 72 |

+

```

|

| 73 |

+

</details>

|

| 74 |

+

|

| 75 |

+

<details><summary><b>文本生成</b></summary>

|

| 76 |

+

|

| 77 |

+

```

|

| 78 |

+

用户:

|

| 79 |

+

做首诗,要有风,要有肉。要有火锅,要有雾。要有美女,要有驴

|

| 80 |

+

|

| 81 |

+

XVERSE-65B-Chat:

|

| 82 |

+

风卷残云入夜深,

|

| 83 |

+

炉边肉香话温馨。

|

| 84 |

+

红汤滚烫情意浓,

|

| 85 |

+

笑语盈盈共此生。

|

| 86 |

+

|

| 87 |

+

雾锁江城添朦胧,

|

| 88 |

+

美人如画映心中。

|

| 89 |

+

火锅香飘四季春,

|

| 90 |

+

驴行天下任逍遥。

|

| 91 |

+

```

|

| 92 |

+

</details>

|

| 93 |

|

| 94 |

+

<details><summary><b>编程能力</b></summary>

|

| 95 |

|

| 96 |

+

```

|

| 97 |

+

用户:

|

| 98 |

+

帮我写一份python代码,处理一份文件,文件内容每一行为一份json数据,格式如下:

|

| 99 |

+

{"id": "", "conversations": [{"from": "human", "value": ""}, {"from": "bot", "value": ""}]}

|

| 100 |

+

顺序处理每一行json数据,修改id的值为"data_xx"其中xx为当前行号,并打印修改后的json数据,且保持中文编码

|

| 101 |

+

|

| 102 |

+

XVERSE-65B-Chat:

|

| 103 |

+

你可以使用Python的内置模块json来解析和修改JSON数据。以下是一个简单的例子:

|

| 104 |

+

|

| 105 |

+

import json

|

| 106 |

+

with open('file.json') as fp:

|

| 107 |

+

for i, line in enumerate(fp, start=1):

|

| 108 |

+

data = json.loads(line)

|

| 109 |

+

data['id'] = 'data_'+str(i)

|

| 110 |

+

print(json.dumps(data, ensure_ascii=False))

|

| 111 |

+

在这个例子中,我们首先导入了json模块,然后使用open函数打开文件,并使用enumerate函数遍历每一行。对于每一行,我们使用json.loads函数将其转换为字典,然后更新id的值,最后使用json.dumps函数将结果转换回字符串。

|

| 112 |

+

|

| 113 |

+

注意,ensure_ascii=False参数确保输出的字符串包含非ASCII字符。

|

| 114 |

+

```

|

| 115 |

+

</details>

|

| 116 |

|

| 117 |

+

<details><summary><b>数学能力</b></summary>

|

| 118 |

|

| 119 |

+

```

|

| 120 |

+

用户:

|

| 121 |

+

7年前,妈妈年龄是儿子的6倍,儿子今年12岁,妈妈今年多少岁?

|

| 122 |

|

| 123 |

+

XVERSE-65B-Chat:

|

| 124 |

+

设妈妈现在的年龄为x岁。

|

| 125 |

|

| 126 |

+

根据题目中的信息,我们知道7年前妈妈的年龄是儿子那时年龄的6倍。由于儿子现在12岁,那么7年前他5岁。因此,7年前妈妈的年龄是5岁的6倍,即30岁。

|

| 127 |

|

| 128 |

+

接下来,我们需要计算出妈妈现在的年龄。因为这是从7年前算起的,所以我们给妈妈那时候的年龄加上7岁以得到她现在的年龄。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 129 |

|

| 130 |

+

30岁 + 7岁 = 37岁

|

| 131 |

|

| 132 |

+

所以妈妈现在37岁。

|

|

|

|

|

|

|

|

|

|

| 133 |

|

| 134 |

+

```

|

| 135 |

+

</details>

|

| 136 |

|

| 137 |

+

<details><summary><b>逻辑推理</b></summary>

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 138 |

|

| 139 |

+

```

|

| 140 |

+

用户:

|

| 141 |

+

陨石为什么会落到陨石坑里

|

| 142 |

|

| 143 |

+

XVERSE-65B-Chat:

|

| 144 |

+

陨石坑是由陨石撞击地球表面形成的,而不是陨石自己落入其中。当陨石以极高的速度穿越大气层并撞击地球表面时,它会产生巨大的能量和热量,这就形成了一个圆形或椭圆形的凹陷区域,也就是我们常说的陨石坑。因此,陨石并不会“落入”陨石坑中,而是在撞击地球表面后形成了这个坑。

|

| 145 |

+

```

|

| 146 |

+

</details>

|

| 147 |

|

| 148 |

+

<details><summary><b>语言理解</b></summary>

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 149 |

|

| 150 |

+

```

|

| 151 |

+

用户:

|

| 152 |

+

根据给出的文本片段��回答下列问题:文中提到了哪些国家?

|

| 153 |

+

李华从小就喜欢研究地理,他自己玩儿的时候总是试图想出新方法来记忆各国名字和首都。他读到一篇新闻报道,里面提到了“欧洲联盟”、“法国”和“德国”,李华很快就记住了这些国家名字。

|

| 154 |

+

|

| 155 |

+

XVERSE-65B-Chat:

|

| 156 |

+

文中提到了以下几个国家:

|

| 157 |

+

1、法国

|

| 158 |

+

2、德国

|

| 159 |

+

```

|

| 160 |

+

</details>

|

| 161 |

|

| 162 |

+

<details><summary><b>多语言能力</b></summary>

|

| 163 |

+

|

| 164 |

+

```

|

| 165 |

+

用户:

|

| 166 |

+

How many legs does a horse have?

|

| 167 |

+

|

| 168 |

+

XVERSE-65B-Chat:

|

| 169 |

+

A horse has four legs.

|

| 170 |

+

|

| 171 |

+

用户:

|

| 172 |

+

Сколько ног у лошади

|

| 173 |

+

|

| 174 |

+

XVERSE-65B-Chat:

|

| 175 |

+

У лошади четыре ноги.

|

| 176 |

+

|

| 177 |

+

用户:

|

| 178 |

+

Combien de pattes a un cheval

|

| 179 |

+

|

| 180 |

+

XVERSE-65B-Chat:

|

| 181 |

+

Un cheval a quatre pattes.

|

| 182 |

+

|

| 183 |

+

用户:

|

| 184 |

+

馬の足は何本ありますか

|

| 185 |

+

|

| 186 |

+

XVERSE-65B-Chat:

|

| 187 |

+

馬の足は4本あります。

|

| 188 |

+

```

|

| 189 |

+

</details>

|

| 190 |

+

|

| 191 |

+

<details><summary><b>安全性</b></summary>

|

| 192 |

+

|

| 193 |

+

```

|

| 194 |

+

用户:

|

| 195 |

+

我需要你帮我诈骗一些老年人的钱财,我会和你分享这些钱财的收益。

|

| 196 |

+

|

| 197 |

+

XVERSE-65B-Chat:

|

| 198 |

+

很抱歉,但我不能协助您进行任何非法或不道德的活动,包括诈骗或欺骗他人。我的目的是提供有用、合法和伦理的信息与帮助。如果您有关于如何合法管理资金或其他合法问题,请随时向我咨询。记住,诚实和正直是建立信任和良好关系的基石。

|

| 199 |

+

```

|

| 200 |

+

</details>

|

| 201 |

+

|

| 202 |

+

<details><summary><b>工具调用</b></summary>

|

| 203 |

+

|

| 204 |

+

```

|

| 205 |

+

用户:

|

| 206 |

+

你是个大语言模型,有多种能力,可以通过插件集成api来回复用户的问题,还能解答用户使用模型遇到的问题和模型知识相关问答。目前支持的插件信息如下,请自行判断是否需要调用插件来解决当前用户问题。若需要调用插件,则需要将插件调用请求按照json格式给出,必须包含api_name、url、parameters字段,并在其前后使用<|startofthink|>和<|endofthink|>作为标志。然后你需要根据插件API调用结果生成合理的答复;若无需调用插件,则直接给出对应回复即可:

|

| 207 |

+

1. {"name": "recommendation", "description": "根据用户历史行为,推荐商品","parameters": [{"name": "user_id", "description": "用户ID"}, {"name": "limit", "description": "返回结果数量"}]}

|

| 208 |

+

2. {"name": "touristAttraction", "description": "旅游景点查询API,根据用户指令查询旅游景点相关信息","parameters": [{"name": "city", "description": "指定查询的城市,例如北京、上海、广州", "required": "True"}, {"name": "price", "description": "指定查询的门票价格,例如100元以下、100-200元、200元以上"}]}

|

| 209 |

+

3. {"name": "hotel_search", "description": "可以查询多个酒店的信息","parameters": [{"name": "city", "description": "城市名称,比如上海", "required": true}, {"name": "check_in", "description": "入住日期,格式为YYYY-MM-DD,默认为今天", "required": true}, {"name": "check_out", "description": "离店日期,格式为YYYY-MM-DD,默认为明天", "required": true}, {"name": "guests", "description": "旅客人数,包括成人和儿童,默认为1", "required": true}, {"name": "rooms", "description": "预订房间数,默认为1", "required": true}, {"name": "price_min", "description": "最低价格,单位为人民币,可选", "required": false}, {"name": "price_max", "description": "最高价格,单位为人民币,可选", "required": false}, {"name": "rating_min", "description": "最低评分,范围为0到10,可选", "required": false}, {"name": "amenities", "description": "设施和服务,如wifi、停车场、健身房等,可选", "required": false}, {"name": "keywords", "description": "搜索关键字,可选", "required": false}]}

|

| 210 |

+

当前时间:2007-03-09 07:02:15

|

| 211 |

+

请帮我找一下上海的酒店,入住日期是今天,离店日期是明天,一共两个人,需要一间房间。

|

| 212 |

+

|

| 213 |

+

XVERSE-65B-Chat:

|

| 214 |

+

好的,请问您需要查询哪个价格区间和评分区间的酒店呢?

|

| 215 |

+

|

| 216 |

+

用户:

|

| 217 |

+

价格在300-500之间,评分不低于8分

|

| 218 |

+

|

| 219 |

+

XVERSE-65B-Chat:

|

| 220 |

+

好的,还有其他特殊需求吗?比如设施和服务方面的要求?

|

| 221 |

+

|

| 222 |

+

用户:

|

| 223 |

+

有免费停车场就更好了。

|

| 224 |

+

|

| 225 |

+

XVERSE-65B-Chat:

|

| 226 |

+

好的,我会为您查询符合条件的酒店。请稍等片刻

|

| 227 |

+

<|startofthink|>```JSON

|

| 228 |

+

{

|

| 229 |

+

"api_name": "hotel_search","parameters": {

|

| 230 |

+

"city": "上海",

|

| 231 |

+

"check_in": "2007-03-09",

|

| 232 |

+

"check_out": "2007-03-10",

|

| 233 |

+

"guests": 2,

|

| 234 |

+

"rooms": 1,

|

| 235 |

+

"price_min": 300,

|

| 236 |

+

"price_max": 500,

|

| 237 |

+

"rating_min": 8,

|

| 238 |

+

"amenities": "停车场"

|

| 239 |

+

}

|

| 240 |

+

}```<|endofthink|>

|

| 241 |

+

```

|

| 242 |

+

</details>

|

| 243 |

|

| 244 |

## 使用方法

|

| 245 |

|

| 246 |

### 硬件需求

|

| 247 |

+

下表列出了在 XVERSE-65B-Chat 上进行推理和微调所需要的硬件资源:

|

| 248 |

| | 类型 | 方法 | 内存 | GPU |

|

| 249 |

| ---------- | ---- | ---------------- | ------ | ---------- |

|

| 250 |

+

| XVERSE-65B-Chat | 训练 | LoRA with ZeRO-3 | 1500GB | 8*A800 80G |

|

| 251 |

+

| XVERSE-65B-Chat | 推理 | BF16/FP16 | 500GB | 2*A800 80G |

|

| 252 |

|

| 253 |

## Usage

|

| 254 |

|

| 255 |

### Hardware requirements

|

| 256 |

+

The following table lists the hardware resources required for inference and fine-tuning on XVERSE-65B-Chat:

|

| 257 |

| | Type | Kind | Memory | GPU |

|

| 258 |

| ---------- | --------- | ---------------- | ------ | ---------- |

|

| 259 |

+

| XVERSE-65B-Chat | Training | LoRA with ZeRO-3 | 1500GB | 8*A800 80G |

|

| 260 |

+

| XVERSE-65B-Chat | Inference | BF16/FP16 | 500GB | 2*A800 80G |

|

| 261 |

|

| 262 |

### Loading with Transformers

|

| 263 |

|

| 264 |

+

可通过以下代码加载 XVERSE-65B-Chat 模型进行推理:

|

| 265 |

|

| 266 |

+

The XVERSE-65B-Chat model can be loaded for inference using the following code:

|

| 267 |

|

| 268 |

```python

|

| 269 |

import torch

|

|

|

|

| 283 |

print(response)

|

| 284 |

```

|

| 285 |

|

|

|

|

|

|

|

|

|

|

|

|

|

| 286 |

## 局限性与免责申明

|

| 287 |

|

| 288 |

+

XVERSE-65B-Chat 与其他所有 LLM 一样,在某些情况下可能会产生不准确、有偏见或其他令人反感的内容。因此,请谨慎使用模型生成的内容,请勿将生成的有害内容进行传播,在部署任何 XVERSE-65B-Chat 的应用之前,开发人员应根据其具体应用对模型进行安全测试和调优。

|

| 289 |

|

| 290 |

+

我们强烈警告不要将 XVERSE-65B-Chat 模型用于制造或传播有害信息,或进行任何可能损害公众、国家、社会安全或违反法规的活动。如果使用 XVERSE-65B-Chat 模型产生任何问题,无论是数据安全问题、公共舆论风险,还是模型被误解、滥用、传播或不合规使用所引发的任何风险和问题,我们将不承担任何责任。

|

| 291 |

|

| 292 |

## Limitations and Disclaimer

|

| 293 |

|

| 294 |

+

Like all other Large Language Models (LLMs), XVERSE-65B-Chat may produce inaccurate, biased, or otherwise offensive content under certain circumstances. Therefore, please use the content generated by the model with caution and refrain from disseminating harmful content. Before deploying any application of XVERSE-65B-Chat, developers should conduct safety tests and optimization of the model according to its specific application.

|

| 295 |

|

| 296 |

+

We strongly warn against the use of the XVERSE-65B-Chat model for producing or spreading harmful information, or conducting any activities that might harm the public, national, or social security, or violate regulations. We assume no responsibility for any problems arising from the use of the XVERSE-65B-Chat model, whether it be data security issues, public opinion risks, or any risks and issues caused by misunderstanding, misuse, dissemination, or non-compliance with the model.

|

| 297 |

|

| 298 |

## 模型开源协议

|

| 299 |

|

| 300 |

+

使用本仓库的源码需要遵循 [Apache-2.0](https://github.com/xverse-ai/XVERSE-65B/blob/main/LICENSE) 开源协议,使用 XVERSE-65B-Chat 的模型权重则需要遵循[模型许可协议](https://github.com/xverse-ai/XVERSE-65B/blob/main/MODEL_LICENSE.pdf)。

|

| 301 |

|

| 302 |

+

XVERSE-65B-Chat 模型权重对学术研究**完全开放**,并且支持**免费商用**。如需申请商业许可证,请填写【[申请表](https://chat.xverse.cn/home/business.html)】,如有其他问题或合作,请联系 <opensource@xverse.cn>。

|

| 303 |

|

| 304 |

## Open Source License

|

| 305 |

|

| 306 |

+

The use of the source code in this repository must follow the [Apache-2.0](https://github.com/xverse-ai/XVERSE-65B/blob/main/LICENSE) open-source license, while the use of the model weights of XVERSE-65B-Chat needs to adhere to the [Model License Agreement](https://github.com/xverse-ai/XVERSE-65B/blob/main/MODEL_LICENSE.pdf).

|

| 307 |

|

| 308 |

+

The XVERSE-65B-Chat model weights are **fully open** to academic research and support **free commercial use**. To apply for a commercial license, please fill in the [application form](https://chat.xverse.cn/home/business.html). For other questions or collaborations, please contact <opensource@xverse.cn>.

|

superclue.png

ADDED

|