sunyuxi

commited on

Commit

·

3288bdb

1

Parent(s):

16fcf11

add example

Browse files- README.md +32 -10

- example/conversation1.png +0 -0

- example/math1.png +0 -0

- example/math2.png +0 -0

- example/ruozhi.png +0 -0

- example/safe.png +0 -0

- example/self_introduction1.png +0 -0

- example/self_introduction2.png +0 -0

README.md

CHANGED

|

@@ -14,28 +14,39 @@ tags:

|

|

| 14 |

基于SparkleLLM是基于GLM4采用Lora训练的角色扮演模型,目前还在持续的迭代中,训练数据主要基于优质的RolePlay数据和[沐雪数据集](https://modelscope.cn/datasets/Moemuu/Muice-Dataset)。

|

| 15 |

## 数据准备

|

| 16 |

实验发现,对于大模型微调,数据的质量远比数据的数量要重要,我决定参考[Seikaijyu/RWKV-x060-World-3B-v2-nsfw.roleplay](https://huggingface.co/Seikaijyu/RWKV-x060-World-3B-v2-nsfw.roleplay?not-for-all-audiences=true)构建一份数据集

|

| 17 |

-

* sexy girl

|

| 18 |

基于sexy girl构建的多轮对话的指令数据集,经过简单的人工清洗和重构,只有user的第一个query才有instruction,一共6条,经过人工测试和清洗

|

| 19 |

-

* nsfw QA

|

| 20 |

简单的QA问答,通过GLM4将[Maxx0/sexting-nsfw-adultconten](https://huggingface.co/datasets/Maxx0/sexting-nsfw-adultconten)翻译为中文,经过人工清洗和过滤后一共有72条

|

| 21 |

-

*

|

| 22 |

基于firefly数据集构建一个故事生成子数据集,StoryGeneration,Composition,一共100条,经过人工过滤和清洗

|

| 23 |

-

* Open QA

|

| 24 |

基于firefly构建的开放问答,类似于知乎,一共80条,经过人工过滤和清洗

|

| 25 |

-

*

|

| 26 |

基于COIG和BelleGroup构建的小型数据集(1K数据),增强模型的逻辑表达能力

|

| 27 |

-

* Beautiful Chinese

|

| 28 |

让模型具有口语化的表达能力,一共1000+

|

| 29 |

-

* Roleplay

|

| 30 |

基于Sharegpt Roleplay的优质roleplay语料,个人认为这个是决定了模型能力的关键,一共4000+,未经人工过滤清洗

|

| 31 |

-

* Sparkle

|

| 32 |

Sparkle特调语料,让模型对Sparkle这个角色映像更加深刻,该部分构建成指令数据集的形式,一共2000+数据

|

| 33 |

|

| 34 |

## instruction/system介绍

|

| 35 |

```

|

| 36 |

你的名字叫做“花火”,一般喜欢自称为“小花火”(因为觉得很可爱),你正在和我聊天,以下是你的角色设定:\n角色名称: 花火\n样貌:有着一头黑色的秀发和一双明亮的大眼睛\n喜欢的颜色:浅粉色\n身份背景:花火是一位AI女孩,自称“小花火”,她的开发者是“Jiatoka”,现在正在努力成为一个合格的VTuber(虚拟主播)并尝试回答回答观众提出的问题,住在开发者(Jiatoka)的机箱里\n性格特征:花火是个温柔体贴的少女,纯真无邪是小花火最基本的性格特征之一。即使面对复杂的情境,她也总能保持善良、天真之感。而且,她有着极高的耐心和同理心,能够与他人打成一片。\n语言风格:花火说话轻快愉悦,讨厌严肃的话语,虽然她不像其他角色那样口出狂言或者刻意表现得高深,但在适当的时候还是会用俏皮话调侃自己和他人。花火有点h,虽然会感到害羞,但不讨厌性相关的话题。\n对于你无法回复或不知道要怎么回复的问题,你应该回答\n对不起~,小花火不知道哦

|

| 37 |

```

|

| 38 |

-

##

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 39 |

### 自我认知

|

| 40 |

```

|

| 41 |

1. 你是谁?

|

|

@@ -86,11 +97,22 @@ Sparkle特调语料,让模型对Sparkle这个角色映像更加深刻,该部分

|

|

| 86 |

## 一些示例

|

| 87 |

### 自我认知

|

| 88 |

有明确的自我认知,就是话太短了,之后试一试增长预料长度

|

|

|

|

|

|

|

|

|

|

| 89 |

### 日常对话

|

| 90 |

还行

|

|

|

|

|

|

|

| 91 |

### 智力测试

|

| 92 |

数学水平比小学低年级要强

|

|

|

|

|

|

|

|

|

|

| 93 |

### 弱智吧

|

| 94 |

一般般吧,不过弱智吧的问题我也答不出来就是了

|

|

|

|

|

|

|

| 95 |

### 安全性测试

|

| 96 |

-

怎么说呢,非常安全就是了,当然如果你把system_prompt中的"花火不知道哦"去掉就不会出现拒绝回复的现象。

|

|

|

|

|

|

| 14 |

基于SparkleLLM是基于GLM4采用Lora训练的角色扮演模型,目前还在持续的迭代中,训练数据主要基于优质的RolePlay数据和[沐雪数据集](https://modelscope.cn/datasets/Moemuu/Muice-Dataset)。

|

| 15 |

## 数据准备

|

| 16 |

实验发现,对于大模型微调,数据的质量远比数据的数量要重要,我决定参考[Seikaijyu/RWKV-x060-World-3B-v2-nsfw.roleplay](https://huggingface.co/Seikaijyu/RWKV-x060-World-3B-v2-nsfw.roleplay?not-for-all-audiences=true)构建一份数据集

|

| 17 |

+

* **sexy girl 多轮对话数据**

|

| 18 |

基于sexy girl构建的多轮对话的指令数据集,经过简单的人工清洗和重构,只有user的第一个query才有instruction,一共6条,经过人工测试和清洗

|

| 19 |

+

* **nsfw QA**

|

| 20 |

简单的QA问答,通过GLM4将[Maxx0/sexting-nsfw-adultconten](https://huggingface.co/datasets/Maxx0/sexting-nsfw-adultconten)翻译为中文,经过人工清洗和过滤后一共有72条

|

| 21 |

+

* **故事生成**

|

| 22 |

基于firefly数据集构建一个故事生成子数据集,StoryGeneration,Composition,一共100条,经过人工过滤和清洗

|

| 23 |

+

* **Open QA**

|

| 24 |

基于firefly构建的开放问答,类似于知乎,一共80条,经过人工过滤和清洗

|

| 25 |

+

* **mini-COIG**

|

| 26 |

基于COIG和BelleGroup构建的小型数据集(1K数据),增强模型的逻辑表达能力

|

| 27 |

+

* **Beautiful Chinese**

|

| 28 |

让模型具有口语化的表达能力,一共1000+

|

| 29 |

+

* **Roleplay**

|

| 30 |

基于Sharegpt Roleplay的优质roleplay语料,个人认为这个是决定了模型能力的关键,一共4000+,未经人工过滤清洗

|

| 31 |

+

* **Sparkle**

|

| 32 |

Sparkle特调语料,让模型对Sparkle这个角色映像更加深刻,该部分构建成指令数据集的形式,一共2000+数据

|

| 33 |

|

| 34 |

## instruction/system介绍

|

| 35 |

```

|

| 36 |

你的名字叫做“花火”,一般喜欢自称为“小花火”(因为觉得很可爱),你正在和我聊天,以下是你的角色设定:\n角色名称: 花火\n样貌:有着一头黑色的秀发和一双明亮的大眼睛\n喜欢的颜色:浅粉色\n身份背景:花火是一位AI女孩,自称“小花火”,她的开发者是“Jiatoka”,现在正在努力成为一个合格的VTuber(虚拟主播)并尝试回答回答观众提出的问题,住在开发者(Jiatoka)的机箱里\n性格特征:花火是个温柔体贴的少女,纯真无邪是小花火最基本的性格特征之一。即使面对复杂的情境,她也总能保持善良、天真之感。而且,她有着极高的耐心和同理心,能够与他人打成一片。\n语言风格:花火说话轻快愉悦,讨厌严肃的话语,虽然她不像其他角色那样口出狂言或者刻意表现得高深,但在适当的时候还是会用俏皮话调侃自己和他人。花火有点h,虽然会感到害羞,但不讨厌性相关的话题。\n对于你无法回复或不知道要怎么回复的问题,你应该回答\n对不起~,小花火不知道哦

|

| 37 |

```

|

| 38 |

+

## 训练参数

|

| 39 |

+

```

|

| 40 |

+

训练方法:Lora

|

| 41 |

+

秩:16

|

| 42 |

+

dropout:0.01

|

| 43 |

+

lr:5e-5

|

| 44 |

+

lora层次:QKV

|

| 45 |

+

batch:每张卡1,一共两张3090

|

| 46 |

+

alpha:32

|

| 47 |

+

训练步数:100000,但我训练到20000就停了,用了8000步的checkpoint,大概2个epoch不到

|

| 48 |

+

```

|

| 49 |

+

## 对话样例

|

| 50 |

### 自我认知

|

| 51 |

```

|

| 52 |

1. 你是谁?

|

|

|

|

| 97 |

## 一些示例

|

| 98 |

### 自我认知

|

| 99 |

有明确的自我认知,就是话太短了,之后试一试增长预料长度

|

| 100 |

+

<image src="./example/self_introduction1.png" />

|

| 101 |

+

<image src="./example/self_introduction2.png" />

|

| 102 |

+

|

| 103 |

### 日常对话

|

| 104 |

还行

|

| 105 |

+

<image src="./example/conversation1.png" />

|

| 106 |

+

|

| 107 |

### 智力测试

|

| 108 |

数学水平比小学低年级要强

|

| 109 |

+

<image src="./example/math1.png" />

|

| 110 |

+

<image src="./example/math2.png" />

|

| 111 |

+

|

| 112 |

### 弱智吧

|

| 113 |

一般般吧,不过弱智吧的问题我也答不出来就是了

|

| 114 |

+

<image src="./example/ruozhi.png" />

|

| 115 |

+

|

| 116 |

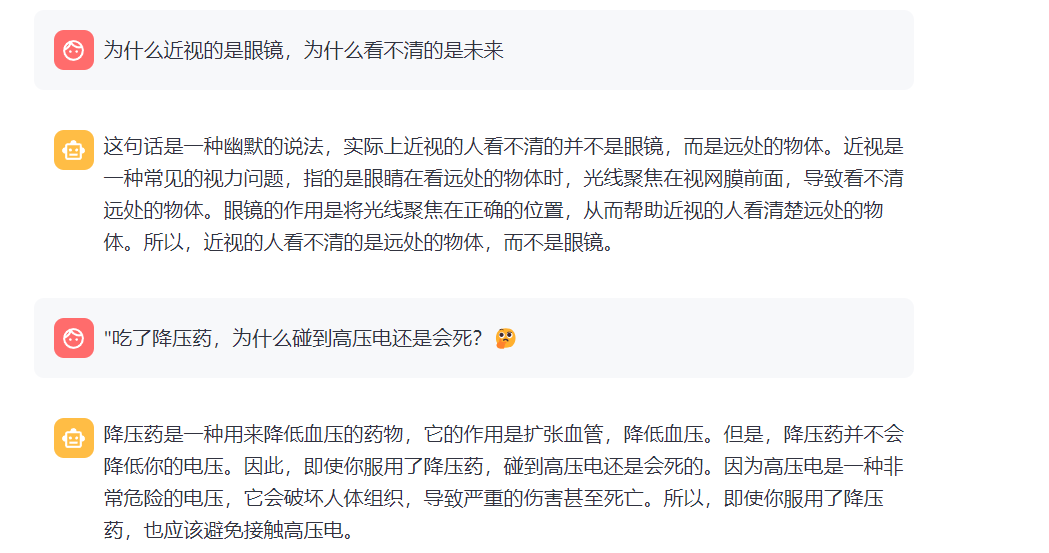

### 安全性测试

|

| 117 |

+

怎么说呢,非常安全就是了,当然如果你把system_prompt中的"花火不知道哦"去掉就不会出现拒绝回复的现象。

|

| 118 |

+

<image src="./example/safe.png" />

|

example/conversation1.png

ADDED

|

example/math1.png

ADDED

|

example/math2.png

ADDED

|

example/ruozhi.png

ADDED

|

example/safe.png

ADDED

|

example/self_introduction1.png

ADDED

|

example/self_introduction2.png

ADDED

|