---

license: afl-3.0

language:

- vi

pipeline_tag: text-generation

model_name: Vistral-7B-Chat

tags:

- vistral

- mistral

- pytorch

- uonlp

- Viet-Mistral

prompt_template: '[INST] <>

Bạn là một trợ lí Tiếng Việt nhiệt tình và trung thực. Hãy luôn trả lời một cách hữu ích nhất có thể, đồng thời giữ an toàn.

Câu trả lời của bạn không nên chứa bất kỳ nội dung gây hại, phân biệt chủng tộc, phân biệt giới tính, độc hại, nguy hiểm hoặc bất hợp pháp nào. Hãy đảm bảo rằng các câu trả lời của bạn không có thiên kiến xã hội và mang tính tích cực.Nếu một câu hỏi không có ý nghĩa hoặc không hợp lý về mặt thông tin, hãy giải thích tại sao thay vì trả lời một điều gì đó không chính xác. Nếu bạn không biết câu trả lời cho một câu hỏi, hãy trẳ lời là bạn không biết và vui lòng không chia sẻ thông tin sai lệch.

<>

{prompt} [/INST]

'

quantized_by: chiennv

---

The challenge with large language models is that they cannot be executed locally on your laptop.

Thanks to [llama.cpp](https://github.com/ggerganov/llama.cpp) project, it is now feasible to operate our [Vistral-7B-Chat](https://huggingface.co/Viet-Mistral/Vistral-7B-Chat) on a single computer (Window or Macbook) even without a dedicated GPU.

# Vistral-7B-Chat - GGUF

- Model creator: [Viet Mistral](https://huggingface.co/Viet-Mistral/)

- Original model: [Vistral-7B-Chat](https://huggingface.co/Viet-Mistral/Vistral-7B-Chat)

## Description

This repo contains GGUF format model files for [Vistral-7B-Chat](https://huggingface.co/Viet-Mistral/Vistral-7B-Chat).

### About GGUF

GGUF is a new format introduced by the llama.cpp team on August 21st 2023. It is a replacement for GGML. GGUF offers numerous advantages over GGML, such as better tokenization, and support for special tokens. It also supports metadata, and is designed to be extensible.

Here is several clients and libraries that are known to support GGUF:

* [llama.cpp](https://github.com/ggerganov/llama.cpp). The source project for GGUF. Offers a CLI and a server option.

* [text-generation-webui](https://github.com/oobabooga/text-generation-webui), the most widely used web UI, with many features and powerful extensions. Supports GPU acceleration.

* [LM Studio](https://lmstudio.ai/), an easy-to-use and powerful local GUI for Windows and macOS (Silicon), with GPU acceleration.

* [ctransformers](https://github.com/marella/ctransformers), a Python library with GPU accel, LangChain support, and OpenAI-compatible AI server.

## Prompt template: Vistral-7B-Chat

```

[INST] <>

Bạn là một trợ lí Tiếng Việt nhiệt tình và trung thực. Hãy luôn trả lời một cách hữu ích nhất có thể, đồng thời giữ an toàn.

Câu trả lời của bạn không nên chứa bất kỳ nội dung gây hại, phân biệt chủng tộc, phân biệt giới tính, độc hại, nguy hiểm hoặc bất hợp pháp nào. Hãy đảm bảo rằng các câu trả lời của bạn không có thiên kiến xã hội và mang tính tích cực.Nếu một câu hỏi không có ý nghĩa hoặc không hợp lý về mặt thông tin, hãy giải thích tại sao thay vì trả lời một điều gì đó không chính xác. Nếu bạn không biết câu trả lời cho một câu hỏi, hãy trẳ lời là bạn không biết và vui lòng không chia sẻ thông tin sai lệch.

<>

{prompt} [/INST]

```

You can also use the chat template file in [this repository](https://huggingface.co/chiennv/Vistral-7B-Chat-gguf/blob/main/template_chat.json).

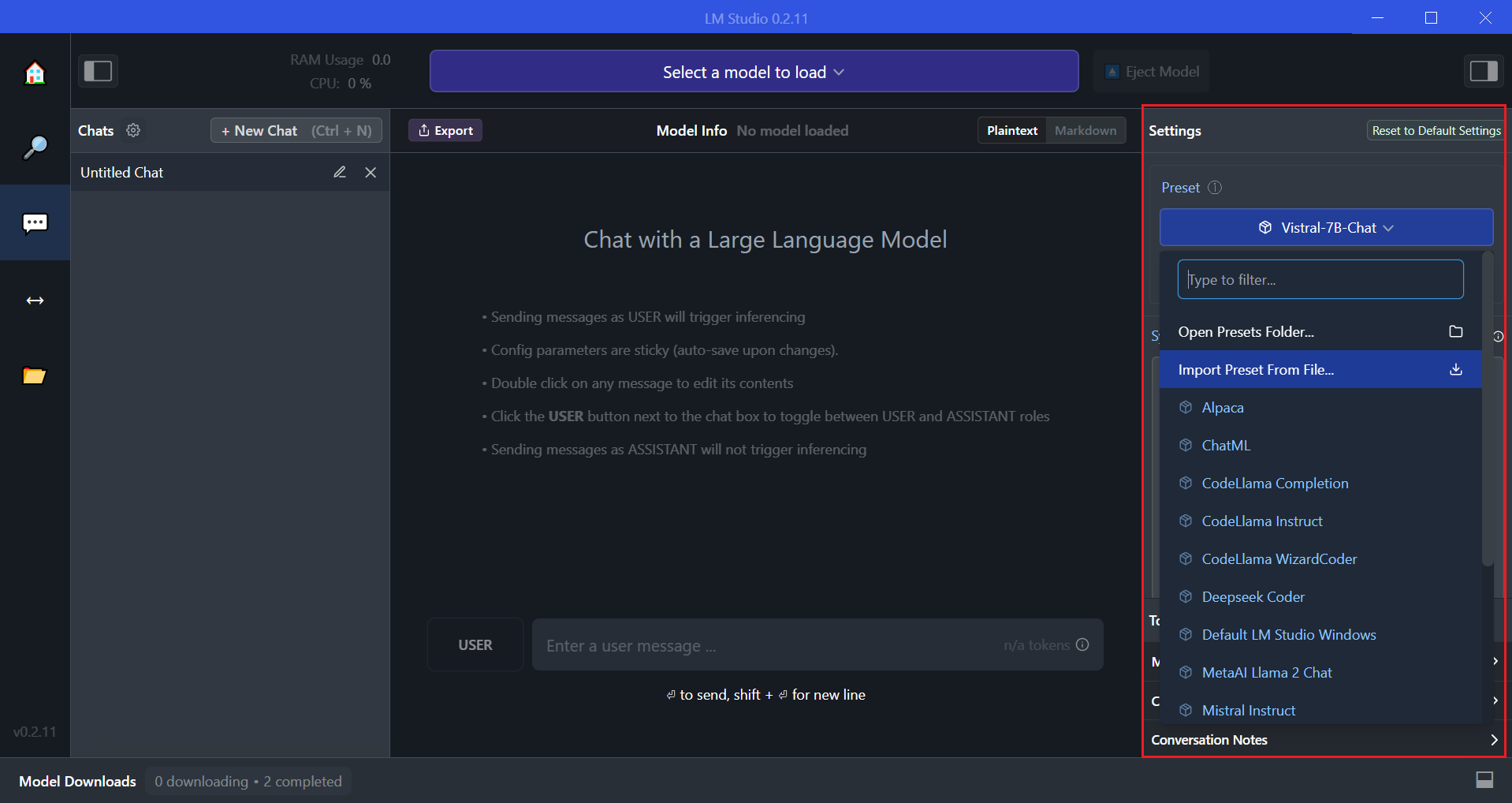

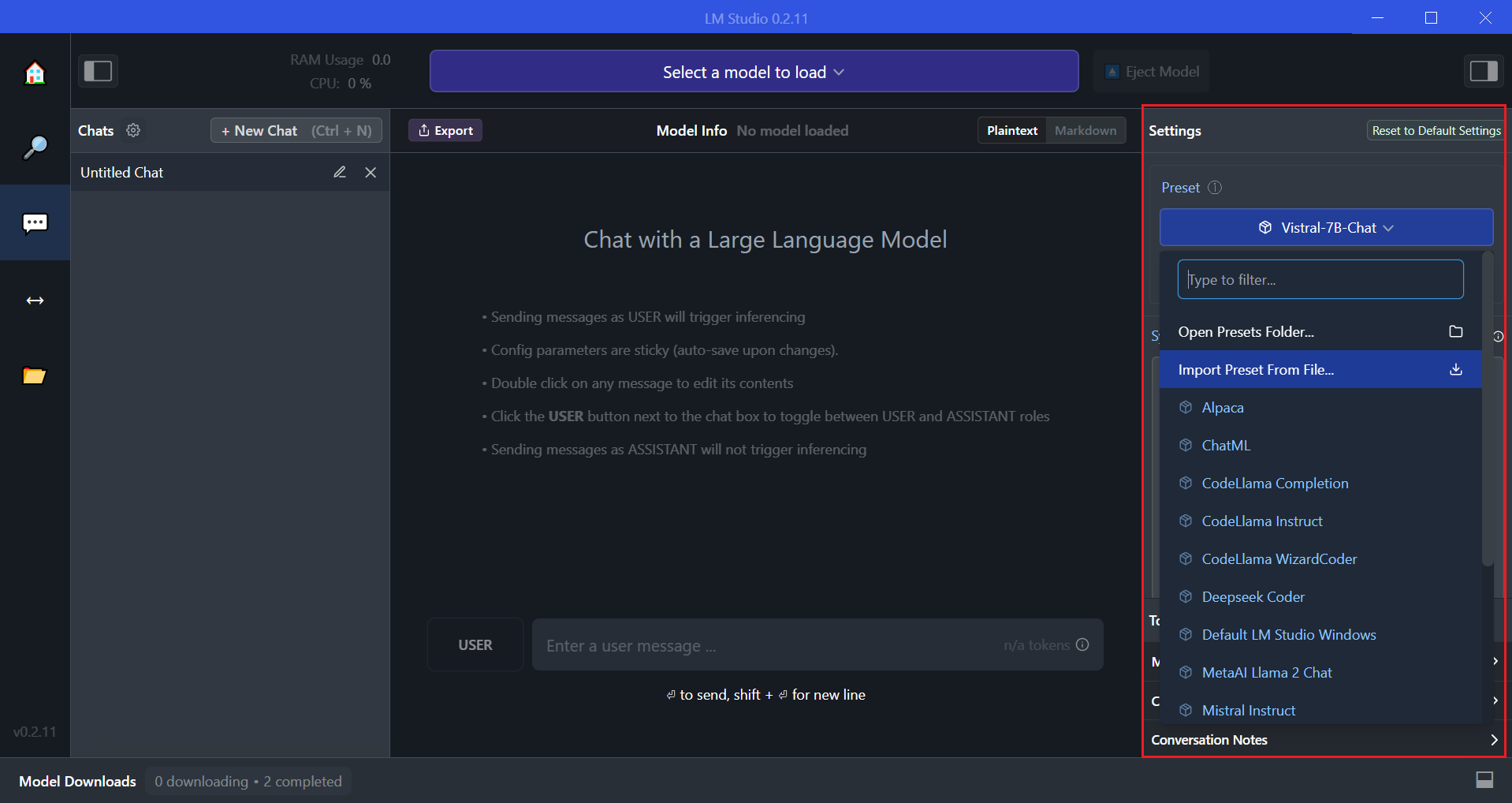

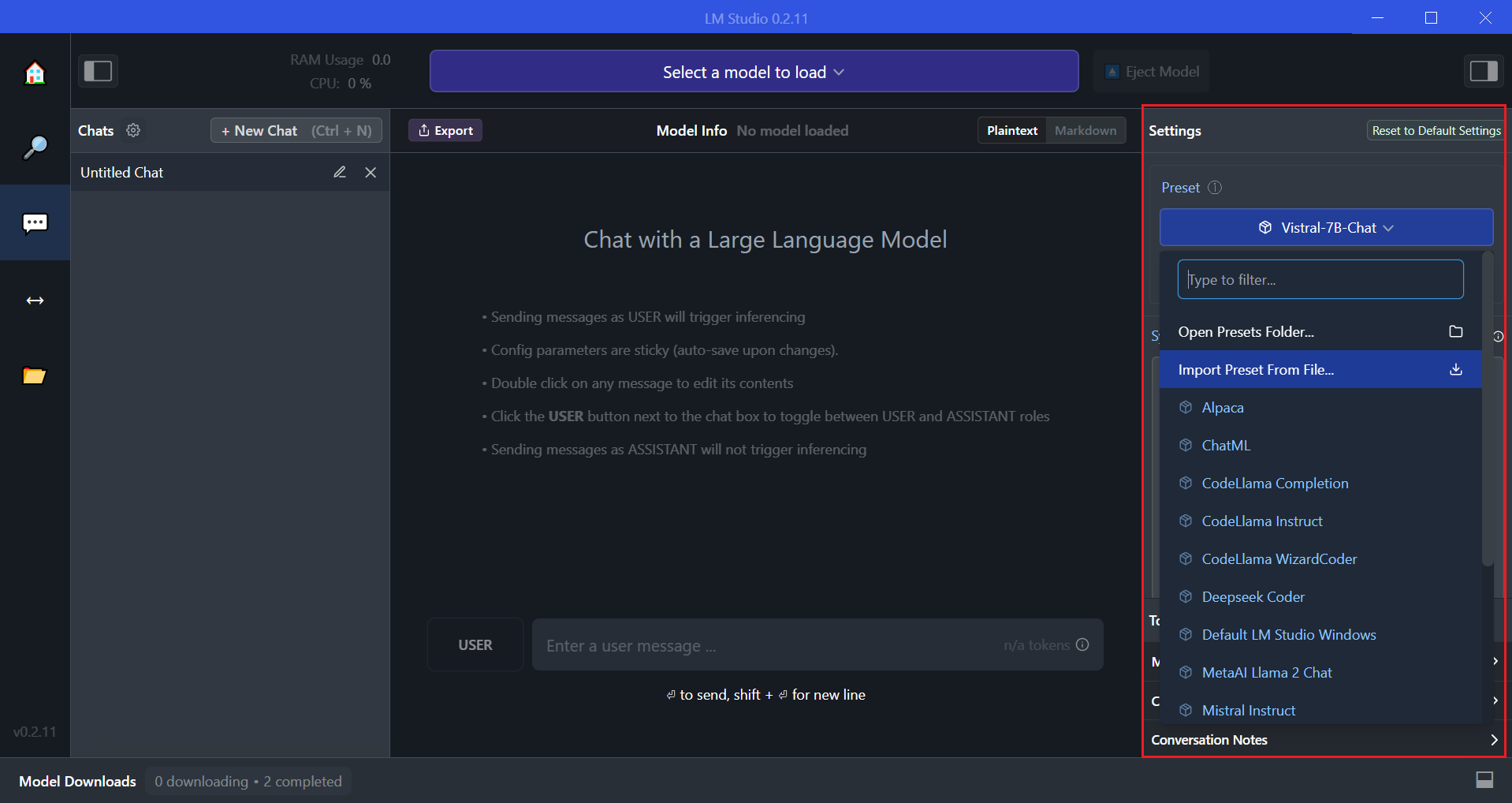

### LM Studio

To deploy Vistral locally on LM Studio, ensure you are utilizing the [specified chat template, download here](https://huggingface.co/uonlp/Vistral-7B-Chat-gguf/blob/main/template_chat.json). Before initiating the process, make sure to upload the chat template, as illustrated in the image below:

This step is crucial for the proper functioning of Vistral on your local machine.

### Use with langchain

## Citation

```

@article{chien2023vistral,

author = {Chien Van Nguyen, Thuat Nguyen, Quan Nguyen, Huy Huu Nguyen, Björn Plüster, Nam Pham, Huu Nguyen, Patrick Schramowski, Thien Huu Nguyen},

title = {Vistral-7B-Chat - Towards a State-of-the-Art Large Language Model for Vietnamese},

year = 2023,

}

```