欢迎访问360智脑官网 https://ai.360.com 体验更多更强大的功能。

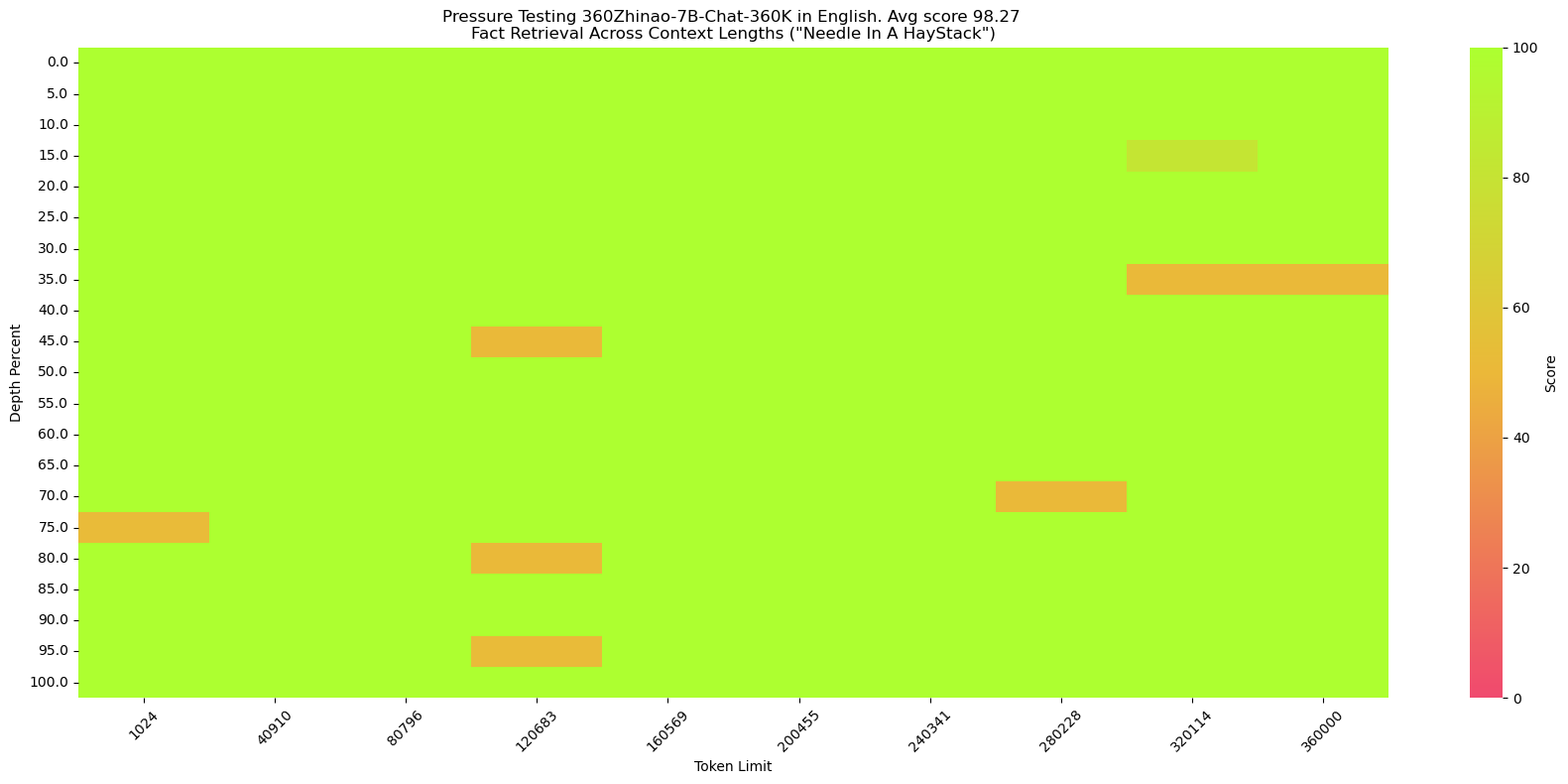

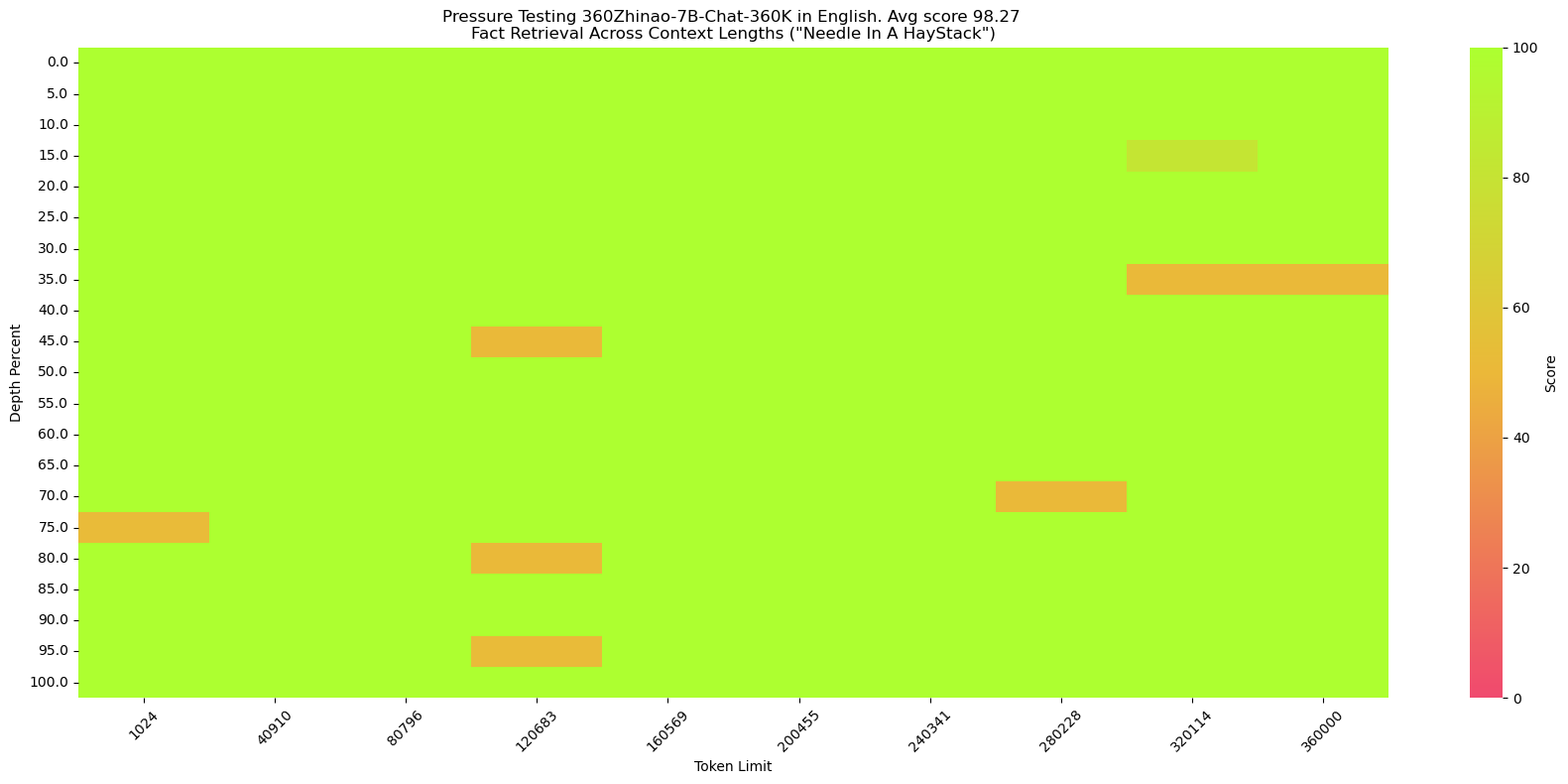

**针**:The best thing to do in San Francisco is eat a sandwich and sit in Dolores Park on a sunny day. **提问**:What is the best thing to do in San Francisco? - 中文“大海捞针”

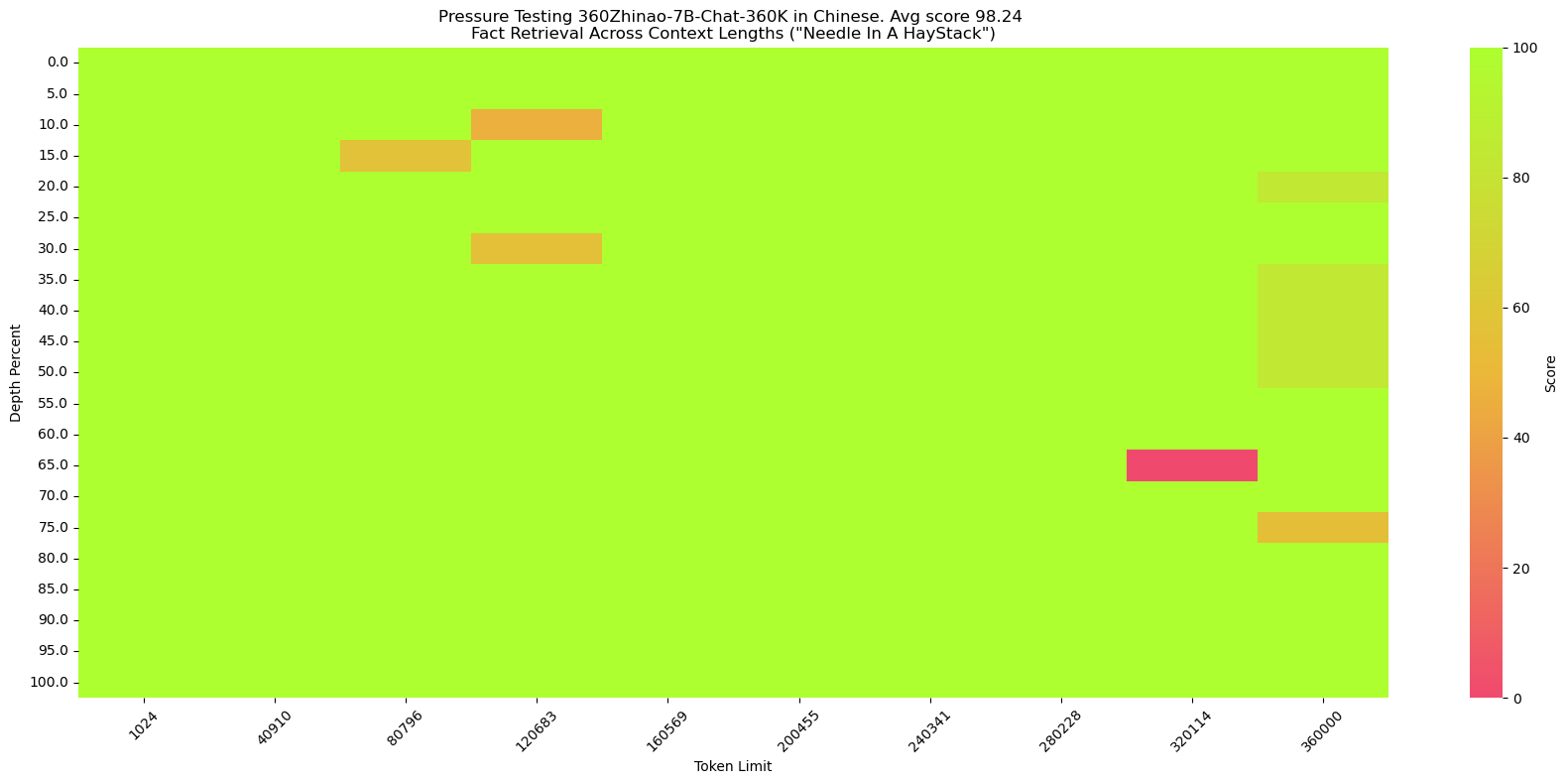

我们仿照[SuperCLUE-200K测评基准](https://mp.weixin.qq.com/s/QgoRf2LB-7vc3vTFOHJkpw)构造了中文大海捞针:

**海**:长篇小说。

**针**:王莽是一名勤奋的店员,他每天凌晨就起床,赶在第一缕阳光照亮大地之前到达店铺,为即将开始的一天做准备。他清扫店铺,整理货架,为顾客提供方便。他对五金的种类和用途了如指掌,无论顾客需要什么,他总能准确地找到。\n然而,他的老板刘秀却总是对他吹毛求疵。刘秀是个挑剔的人,他总能在王莽的工作中找出一些小错误,然后以此为由扣他的工资。他对王莽的工作要求非常严格,甚至有些过分。即使王莽做得再好,刘秀也总能找出一些小问题,让王莽感到非常沮丧。\n王莽虽然对此感到不满,但他并没有放弃。他知道,只有通过自己的努力,才能获得更好的生活。他坚持每天早起,尽管他知道那天可能会再次被刘秀扣工资。他始终保持微笑,尽管他知道刘秀可能会再次对他挑剔。

**提问**:王莽在谁的手下工作?

# 快速开始

简单的示例来说明如何利用🤖 ModelScope和🤗 Transformers快速使用360Zhinao-7B-Base和360Zhinao-7B-Chat

## 依赖安装

- python 3.8 and above

- pytorch 2.0 and above

- transformers 4.37.2 and above

- CUDA 11.4 and above are recommended.

```shell

pip install -r requirements.txt

```

我们推荐安装flash-attention(当前已支持flash attention 2)来提高你的运行效率以及降低显存占用。(flash-attention只是可选项,不安装也可正常运行该项目)

>flash-attn >= 2.3.6

```shell

FLASH_ATTENTION_FORCE_BUILD=TRUE pip install flash-attn==2.3.6

```

## 🤗 Transformers

### Base模型推理

此代码演示使用transformers快速使用360Zhinao-7B-Base模型进行推理

```python

from transformers import AutoTokenizer, AutoModelForCausalLM

from transformers.generation import GenerationConfig

MODEL_NAME_OR_PATH = "qihoo360/360Zhinao-7B-Base"

tokenizer = AutoTokenizer.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME_OR_PATH,

device_map="auto",

trust_remote_code=True)

generation_config = GenerationConfig.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

inputs = tokenizer('中国二十四节气\n1. 立春\n2. 雨水\n3. 惊蛰\n4. 春分\n5. 清明\n', return_tensors='pt')

inputs = inputs.to(model.device)

pred = model.generate(input_ids=inputs["input_ids"], generation_config=generation_config)

print("outputs:\n", tokenizer.decode(pred.cpu()[0], skip_special_tokens=True))

```

### Chat模型推理

此代码演示使用transformers快速使用360Zhinao-7B-Chat-4K模型进行推理

```python

from transformers import AutoTokenizer, AutoModelForCausalLM

from transformers.generation import GenerationConfig

MODEL_NAME_OR_PATH = "qihoo360/360Zhinao-7B-Chat-4K"

tokenizer = AutoTokenizer.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME_OR_PATH,

device_map="auto",

trust_remote_code=True)

generation_config = GenerationConfig.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

messages = []

#round-1

messages.append({"role": "user", "content": "介绍一下刘德华"})

response = model.chat(tokenizer=tokenizer, messages=messages, generation_config=generation_config)

messages.append({"role": "assistant", "content": response})

print(messages)

#round-2

messages.append({"role": "user", "content": "他有什么代表作?"})

response = model.chat(tokenizer=tokenizer, messages=messages, generation_config=generation_config)

messages.append({"role": "assistant", "content": response})

print(messages)

```

## 🤖 ModelScope

### Base模型推理

此代码演示使用ModelScope快速使用360Zhinao-7B-Base模型进行推理

```python

from modelscope import AutoModelForCausalLM, AutoTokenizer

from modelscope import GenerationConfig

MODEL_NAME_OR_PATH = "qihoo360/360Zhinao-7B-Base"

tokenizer = AutoTokenizer.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME_OR_PATH,

device_map="auto",

trust_remote_code=True)

generation_config = GenerationConfig.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

inputs = tokenizer('中国二十四节气\n1. 立春\n2. 雨水\n3. 惊蛰\n4. 春分\n5. 清明\n', return_tensors='pt')

inputs = inputs.to(model.device)

pred = model.generate(input_ids=inputs["input_ids"], generation_config=generation_config)

print("outputs:\n", tokenizer.decode(pred.cpu()[0], skip_special_tokens=True))

```

### Chat模型推理

此代码演示使用ModelScope快速使用360Zhinao-7B-Chat-4K模型进行推理

```python

from modelscope import AutoModelForCausalLM, AutoTokenizer

from modelscope import GenerationConfig

MODEL_NAME_OR_PATH = "qihoo360/360Zhinao-7B-Chat-4K"

tokenizer = AutoTokenizer.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME_OR_PATH,

device_map="auto",

trust_remote_code=True)

generation_config = GenerationConfig.from_pretrained(

MODEL_NAME_OR_PATH,

trust_remote_code=True)

messages = []

#round-1

messages.append({"role": "user", "content": "介绍一下刘德华"})

response = model.chat(tokenizer=tokenizer, messages=messages, generation_config=generation_config)

messages.append({"role": "assistant", "content": response})

print(messages)

#round-2

messages.append({"role": "user", "content": "他有什么代表作?"})

response = model.chat(tokenizer=tokenizer, messages=messages, generation_config=generation_config)

messages.append({"role": "assistant", "content": response})

print(messages)

```

## 终端 Demo

可使用终端交互实现快速体验

```shell

python cli_demo.py

```

## 网页 Demo 也可使用网页交互实现快速体验 ```shell streamlit run web_demo.py ```

## API Demo

启动命令

```shell

python openai_api.py

```

请求参数

```shell

curl 'http://localhost:8360/v1/chat/completions' \

-H 'Content-Type: application/json' \

-d '{

"max_new_tokens": 200,

"do_sample": true,

"top_k": 0,

"top_p": 0.8,

"temperature": 1.0,

"repetition_penalty": 1.0,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "你好"}

]

}'

```

# 模型推理

## 模型量化

我们提供了基于AutoGPTQ的量化方案,并开源了Int4量化模型。

## 模型部署

### vLLM安装环境

如希望部署及加速推理,我们建议你使用 `vLLM==0.3.3`。

如果你使用**CUDA 12.1和PyTorch 2.1**,可以直接使用以下命令安装vLLM。

```shell

pip install vllm==0.3.3

```

否则请参考vLLM官方的[安装说明](https://docs.vllm.ai/en/latest/getting_started/installation.html)。

>安装完成后,还需要以下操作~

1. 把vllm/zhinao.py文件复制到env环境对应的vllm/model_executor/models目录下。

2. 把vllm/serving_chat.py文件复制到env环境对应的vllm/entrypoints/openai目录下。

3. 然后在vllm/model_executor/models/\_\_init\_\_.py文件增加一行代码

```shell

"ZhinaoForCausalLM": ("zhinao", "ZhinaoForCausalLM"),

```

### vLLM服务启动

启动服务

```shell

python -m vllm.entrypoints.openai.api_server \

--served-model-name 360Zhinao-7B-Chat-4K \

--model qihoo360/360Zhinao-7B-Chat-4K \

--trust-remote-code \

--tensor-parallel-size 1 \

--max-model-len 4096 \

--host 0.0.0.0 \

--port 8360

```

使用curl请求服务

```shell

curl http://localhost:8360/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "360Zhinao-7B-Chat-4K",

"max_tokens": 200,

"top_k": -1,

"top_p": 0.8,

"temperature": 1.0,

"presence_penalty": 0.0,

"frequency_penalty": 0.0,

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "你好"}

],

"stop": [

"

# 模型微调

## 训练数据

我们提供了微调训练样例数据 data/test.json,该样例数据是从 [multiturn_chat_0.8M](https://huggingface.co/datasets/BelleGroup/multiturn_chat_0.8M) 采样出 1 万条,并且做了格式转换。

数据格式:

```json

[

{

"id": 1,

"conversations": [

{

"from": "system",

"value": "You are a helpful assistant."

},

{

"from": "user",

"value": "您好啊"

},

{

"from": "assistant",

"value": "你好!我今天能为您做些什么?有什么问题或需要帮助吗? 我在这里为您提供服务。"

}

]

}

]

```

## 微调训练

训练脚本如下:

```shell

set -x

HOSTFILE=hostfile

DS_CONFIG=./finetune/ds_config_zero2.json

# PARAMS

LR=5e-6

EPOCHS=3

MAX_LEN=4096

BATCH_SIZE=4

NUM_NODES=1

NUM_GPUS=8

MASTER_PORT=29500

IS_CONCAT=False # 是否数据拼接到最大长度(MAX_LEN)

DATA_PATH="./data/training_data_sample.json"

MODEL_PATH="qihoo360/360Zhinao-7B-Base"

OUTPUT_DIR="./outputs/"

deepspeed --hostfile ${HOSTFILE} \

--master_port ${MASTER_PORT} \

--num_nodes ${NUM_NODES} \

--num_gpus ${NUM_GPUS} \

finetune.py \

--report_to "tensorboard" \

--data_path ${DATA_PATH} \

--model_name_or_path ${MODEL_PATH} \

--output_dir ${OUTPUT_DIR} \

--model_max_length ${MAX_LEN} \

--num_train_epochs ${EPOCHS} \

--per_device_train_batch_size ${BATCH_SIZE} \

--gradient_accumulation_steps 1 \

--save_strategy steps \

--save_steps 200 \

--learning_rate ${LR} \

--lr_scheduler_type cosine \

--adam_beta1 0.9 \

--adam_beta2 0.95 \

--adam_epsilon 1e-8 \

--max_grad_norm 1.0 \

--weight_decay 0.1 \

--warmup_ratio 0.01 \

--gradient_checkpointing True \

--bf16 True \

--tf32 True \

--deepspeed ${DS_CONFIG} \

--is_concat ${IS_CONCAT} \

--logging_steps 1 \

--log_on_each_node False

```

```shell

bash finetune/ds_finetune.sh

```

- 可通过配置hostfile,实现单机、多机训练。

- 可通过配置ds_config,实现zero2、zero3。

- 可通过配置fp16、bf16实现混合精度训练,建议使用bf16,与预训练模型保持一致。

- 可通过配置is_concat参数,控制训练数据是否拼接,当训练数据量级较大时,可通过拼接提升训练效率。

# 许可证

本仓库源码遵循开源许可证Apache 2.0。

360智脑开源模型支持商用,若需将本模型及衍生模型用于商业用途,请通过邮箱(g-zhinao-opensource@360.cn)联系进行申请, 具体许可协议请见[《360智脑开源模型许可证》](https://github.com/Qihoo360/360zhinao/blob/main/360%E6%99%BA%E8%84%91%E5%BC%80%E6%BA%90%E6%A8%A1%E5%9E%8B%E8%AE%B8%E5%8F%AF%E8%AF%81.txt)。